فهرست مطالب

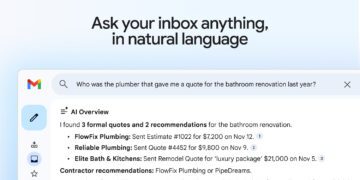

گوگل روز سه شنبه در کنفرانس توسعه دهندگان سالانه Google I/O 2024 مدل هوش مصنوعی جدیدی به نام Gemini 1.5 Pro معرفی کرد که قادر به تحلیل ساعتها ویدیو است.

به گزارش تکناک این مدل میتواند تا دو میلیون توکن داده، معادل دو ساعت ویدیو یا 22 ساعت صدا را پردازش کند. نسخه جدید این مدل از لحاظ تولید کد، استدلال منطقی، مکالمه چندمرحلهای و تحلیل تصاویر و ویدیو بهبود یافته است. نسخهای سبکتر و سریعتر به نام Gemini 1.5 Flash نیز برای کاربردهای کمتقاضا معرفی شده که با هزینه و تأخیر کمتر کار میکند.

نسخه جدید Gemini 1.5 Pro با پشتیبانی از 2 میلیون توکن بزرگترین ورودی را در بین تمام مدلهای موجود در بازار تجاری دارد. دومین مدل بزرگ، کلود 3 از شرکت انتروپیک، تا 1 میلیون توکن را پشتیبانی میکند.

در حوزه هوش مصنوعی، «توکن» به بخشهای خرد شده از داده خام اشاره دارد، مانند بخشهای «فن»، «تاس» و «تیک» در کلمه «فانتزی». دو میلیون توکن معادل حدود 1.4 میلیون کلمه، دو ساعت ویدئو یا 22 ساعت صدا است.

مدلهایی که میتوانند توکنهای بیشتری را دریافت کنند، علاوه بر توانایی تحلیل فایلهای بزرگ، گاهی اوقات میتوانند به عملکرد بهبودیافته دست یابند.

برخلاف مدلهایی با حداکثر ورودی توکن کم (که به عنوان متن شناخته میشوند)، مدلهایی مانند Gemini 1.5 Pro با ورودی 2 میلیون توکن، محتوای مکالمات بسیار اخیر را به راحتی «فراموش نمیکنند» و از مسیر بحث منحرف نمیشوند. مدلهای با متن بزرگ همچنین میتوانند جریان دادههایی را که دریافت میکنند بهتر درک کنند – حداقل در تئوری – و پاسخهای غنیتری از نظر متن تولید کنند.

توسعهدهندگانی که علاقهمند به امتحان کردن Gemini 1.5 Pro با متن 2 میلیون توکن هستند، میتوانند نام خود را به لیست انتظار در Google AI Studio، ابزار توسعه هوش مصنوعی تولیدکننده گوگل، اضافه کنند. (Gemini 1.5 Pro با متن 1 میلیون توکن در ماه آینده در کل خدمات توسعهدهندگان و سطوح گوگل در دسترس عموم قرار میگیرد.)

فراتر از پنجره متن بزرگتر، گوگل میگوید که Gemini 1.5 Pro طی ماههای گذشته از طریق بهبودهای الگوریتمی «تقویت» شده است. به گفته گوگل، این مدل در تولید کد، استدلال منطقی و برنامهریزی، مکالمه چندمرحلهای و درک صدا و تصویر بهتر عمل میکند. همچنین در API و AI Studio، نسخه 1.5 پرو اکنون میتواند علاوه بر تصاویر و ویدئو، روی صدا نیز استدلال کند و از طریق قابلیتی به نام دستورالعملهای سیستم «هدایت» شود.

01

از 02Gemini 1.5 Flash؛ یک مدل سریعتر

گوگل نسخه جدیدی از مدل «Gemini » با نام «Gemini 1.5 Flash» را برای برنامههای کمنیازتر معرفی کرد. این مدل فشرده و کارآمد، نسخهای «مُقطر» شده از « Gemini 1.5 Pro» است که برای کارهای هوش مصنوعی تولیدکننده «محدود» و «بسیار پرکاربرد» ساخته شده است.

«فلش» که پنجرهای حداکثر تا دو میلیون توکنی برای درک زمینه دارد، چندرسانهای است؛ یعنی همانند « Gemini 1.5 Pro» میتواند علاوه بر متن، صدا، تصویر و ویدیو را هم تحلیل کند (اما خروجی آن فقط متن است).

جاش وودوارد، معاون رئیس بخش آزمایشگاههای گوگل، که یکی از بخشهای هوش مصنوعی آزمایشی گوگل است، در جلسهای با خبرنگاران گفت: «جمینی پرو برای کارهای استدلالی بسیار کلیتر یا پیچیدهتر و اغلب چندمرحلهای کاربرد دارد. [اما] بهعنوان یک توسعهدهنده، اگر سرعت خروجی مدل برایتان بسیار اهمیت دارد، واقعا میخواهید از [فلش] استفاده کنید.»

وودوارد اضافه کرد که « Gemini 1.5 Flash » بهویژه برای کارهایی مانند خلاصهسازی متن، برنامههای چت، شرح تصاویر و ویدیوها و استخراج داده از اسناد و جداول بلند مناسب است.

به نظر میرسد « Gemini 1.5 Flash » پاسخ گوگل به مدلهای کوچک و کمهزینهای است که از طریق واسطهای برنامهنویسی ارائه میشوند؛ مانند مدل «کلود ۳ هایکو» از شرکت «آنتروپیک». دسترسی به این مدل و همچنین « Gemini 1.5 Pro» بسیار گسترده است و هماکنون در بیش از ۲۰۰ کشور و منطقه از جمله منطقه اقتصادی اروپا، بریتانیا و سوئیس در دسترس است. (با این حال، نسخه با پنجره متن دو میلیون توکنی در لیست انتظار قرار دارد.)

02

از 02اضافه شدن ویژگی context caching

در به روز رسانی دیگری که برای توسعه دهندگان در نظر گرفته شده است، به زودی همه مدل های Gemini ، نه فقط فلش، قادر خواهند بود از ویژگی ای به نام حافظه کش متن (context caching) استفاده کنند.

این قابلیت به توسعه دهندگان امکان می دهد تا مقادیر زیادی از اطلاعات (مثلا یک پایگاه داده یا بانک اطلاعاتی از مقالات تحقیقاتی) را در یک حافظه کش ذخیره کنند که مدل های Gemini به سرعت و با هزینه نسبتا کم (از نظر استفاده) به آن دسترسی داشته باشند.

رابط برنامه نویسی دسته ای (Batch API) رایگان که امروز در نسخه پیش نمایش عمومی در Vertex AI، پلتفرم توسعه هوش مصنوعی تولید محور گوگل برای شرکت ها، در دسترس است، روشی مقرون به صرفه تر برای مدیریت کارهایی مانند طبقه بندی و تحلیل احساسات، استخراج داده و تولید توضیحات ارائه می دهد و به کاربران این امکان را می دهد که چندین دستورالعمل را در یک درخواست واحد به مدل های جمینی ارسال کنند.

وودوارد پیشنهاد می کند که یک ویژگی جدید دیگر که اواخر ماه جاری در نسخه پیش نمایش در Vertex ارائه می شود، تولید کنترل شده، با اجازه دادن به کاربران برای تعریف خروجی های مدل جمینی مطابق با فرمت ها یا طرحواره های خاص (به عنوان مثال JSON یا XML)، می تواند منجر به صرفه جویی بیشتر در هزینه شود.

وودوارد گفت: «شما میتوانید همه فایلهای خود را یک بار برای مدل ارسال کنید و دیگر لازم نیست آنها را بارها و بارها دوباره ارسال کنید. این امر باید متن طولانی [به طور خاص] را بسیار مفیدتر و همچنین مقرون به صرفه تر کند.»