فهرست مطالب

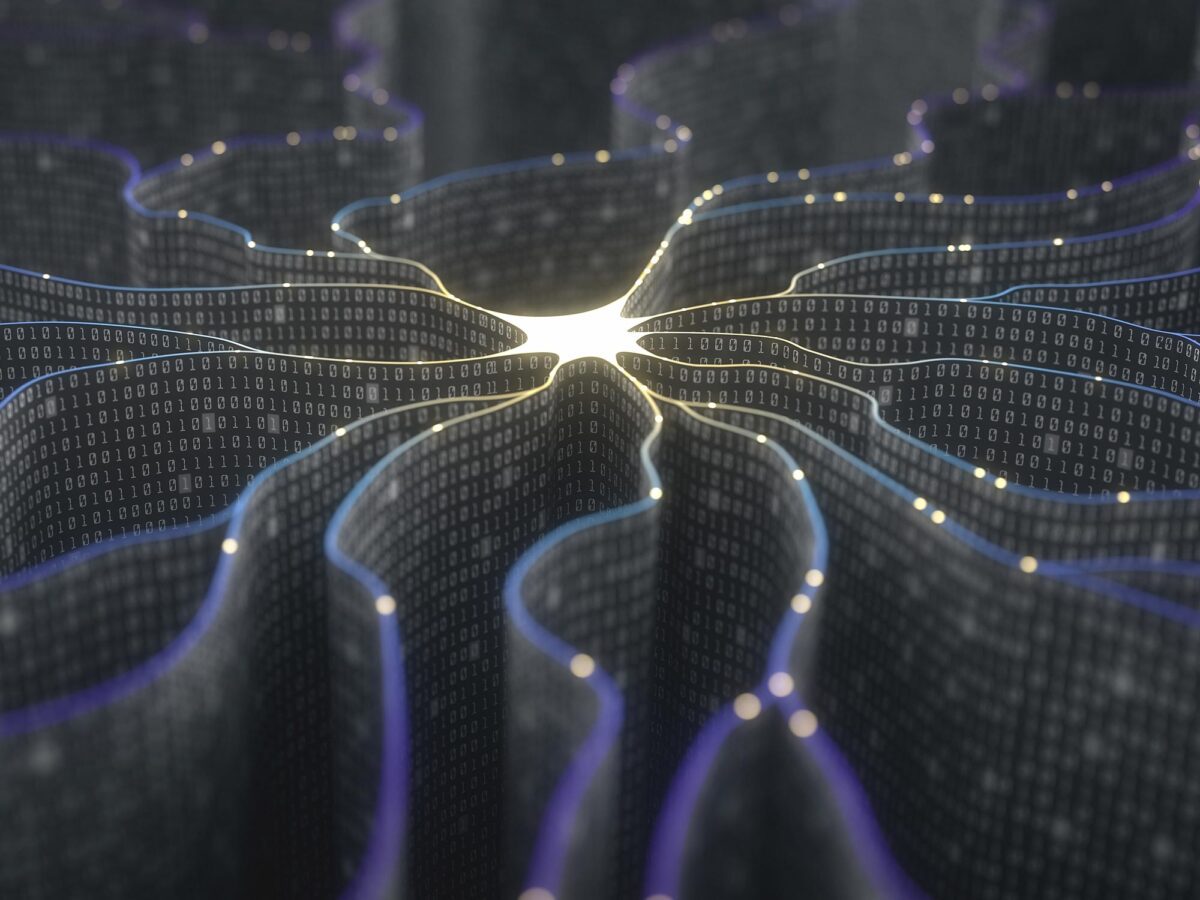

محققان با کنار گذاشتن روش سنتی آموزش تکراری و بهرهگیری از یک رویکرد مبتنی بر احتمال، موفق شدهاند شبکههای عصبی مدلهای هوش مصنوعی را با توان پردازشی بسیار کمتر بهینهسازی کنند.

به گزارش تکناک، این رویکرد که از سیستمهای پویا در طبیعت الهام گرفته شده، میتواند هوش مصنوعی را به فناوریای کممصرفتر و سازگارتر با محیط زیست تبدیل کند، بدون اینکه عملکرد آن دچار افت شود.

01

از 04رشد فزاینده مصرف انرژی در هوش مصنوعی

درحال حاضر هوش مصنوعی بیش از هر زمان دیگری انرژی مصرف میکند و مراکز داده برای پاسخگویی به این تقاضای فزاینده با چالشهای جدی روبهرو هستند. بااینحال، یک روش جدید در آموزش مدلهای هوش مصنوعی میتواند این روند را متحول کرده و در عین حفظ دقت، مصرف انرژی را به میزان چشمگیری کاهش دهد.

فناوریهای مبتنی بر هوش مصنوعی، از جمله مدلهای زبانی بزرگ، به بخش جداییناپذیری از زندگی روزمره تبدیل شدهاند. اما توان پردازشی موردنیاز برای پشتیبانی از این سیستمها توسط مراکز دادهای تأمین میشود که حجم عظیمی از انرژی را مصرف میکنند.

تنها در آلمان، مراکز داده در سال ۲۰۲۰ حدود ۱۶ میلیارد کیلوواتساعت برق مصرف کردهاند که معادل ۱ درصد از کل مصرف انرژی این کشور است. پیشبینیها نشان میدهد که این رقم تا سال ۲۰۲۵ به ۲۲ میلیارد کیلوواتساعت افزایش خواهد یافت.

02

از 04روش جدید: ۱۰۰ برابر سریعتر با دقت مشابه

با افزایش پیچیدگی کاربردهای هوش مصنوعی، نیاز این فناوری به انرژی نیز بیشتر میشود، بهویژه در فرآیند آموزش شبکههای عصبی که به منابع محاسباتی گستردهای نیاز دارد. برای مقابله با این چالش، پژوهشگران روشی نوین ابداع کردهاند که در مقایسه با روشهای سنتی، ۱۰۰ برابر سریعتر عمل کرده و در عین حال همان سطح از دقت را حفظ میکند. این پیشرفت میتواند به کاهش چشمگیر انرژی موردنیاز برای آموزش مدلهای هوش مصنوعی منجر شود.

شبکههای عصبی که در وظایفی مانند پردازش تصویر و زبان به کار گرفته میشوند، بر اساس ساختار مغز انسان طراحی شدهاند. این شبکهها از مجموعهای از گرههای متصل به یکدیگر یا نورونهای مصنوعی تشکیل شدهاند که اطلاعات را با اختصاص مقادیر وزنی به سیگنالهای ورودی پردازش میکنند. زمانی که این مقادیر از یک حد معین فراتر بروند، سیگنال به لایه بعدی منتقل میشود.

آموزش این شبکهها معمولاً فرآیندی بسیار پرهزینه از نظر محاسباتی است. در مرحله ابتدایی، مقادیر پارامترها بهطور تصادفی، معمولاً با استفاده از توزیع نرمال، تعیین میشوند. سپس، سیستم طی چندین مرحله، این مقادیر را تنظیم میکند تا دقت پیشبینیهای خود را افزایش دهد. به دلیل حجم عظیم محاسبات موردنیاز، آموزش شبکههای عصبی مقدار قابلتوجهی برق مصرف میکند.

03

از 04آموزش بهینهتر با پارامترهای احتمالمحور

فلیکس دیتریش، استاد یادگیری ماشین فیزیکمحور، و تیم تحقیقاتی او روشی نوین ابداع کردهاند که در آن، به جای تعیین تدریجی پارامترها بین گرهها، از رویکردی مبتنی بر احتمال استفاده میشود. در این روش، مقادیر بهصورت هدفمند در نقاط بحرانی دادههای آموزشی یعنی مکانهایی که تغییرات سریع و قابل توجهی در مقادیر رخ میدهد اعمال میشوند.

هدف این پژوهش، استفاده از این روش برای استخراج سیستمهای پویا و کممصرف از دادهها است. این سیستمها با گذشت زمان، طبق قوانین مشخصی تغییر میکنند و در حوزههایی مانند مدلسازی آبوهوا و تحلیل بازارهای مالی نیز کاربرد دارند.

04

از 04افزایش بهرهوری انرژی بدون افت دقت

فلیکس دیتریش درباره یافتههای این پژوهش میگوید: «روش ما این امکان را فراهم میکند که پارامترهای موردنیاز را با حداقل توان محاسباتی تعیین کنیم. این رویکرد میتواند آموزش شبکههای عصبی را بسیار سریعتر کرده و در نتیجه، میزان مصرف انرژی را کاهش دهد.» او همچنین تأکید میکند که دقت این روش جدید کاملاً قابل مقایسه با شبکههایی است که از طریق روشهای سنتی و تکراری آموزش داده میشوند.