تحقیقات جدید نشان میدهند که هوش مصنوعی میتواند سوگیریهای انسانی را تقویت و قضاوتها را تحریف کند.

به گزارش تکناک، سوگیری ناخودآگاه یک پزشک میتواند بر درمان بیماران تأثیر بگذارد. پیشداوریهای یک مسئول استخدام ممکن است بر فرایند جذب نیرو تأثیر بگذارد. اما وقتی که هوش مصنوعی وارد این داستانها میشود، چه اتفاقی رخ میدهد؟

بر اساس تحقیقات جدید، سیستمهای هوش مصنوعی نه تنها سوگیریهای ما را انعکاس میدهند، بلکه آنها را تقویت میکنند و کاری انجام میدهند که انسانها با گذشت زمان سوگیریهای بیشتری داشته باشند.

این یافته نگرانکننده از یک تحقیق جدید منتشرشده در مجله Nature Human Behaviour به دست آمده است، که نشان میدهد هوش مصنوعی چگونه میتواند قضاوتهای انسانی را به گونهای شکل دهد که باعث افزایش سوگیریها و اشتباهات موجود شود.

در این تحقیق که ۱۴۰۱ نفر در آن شرکت کردند، محققان کالج دانشگاهی لندن و MIT به این نتیجه رسیدند که حتی سوگیریهای اولیه کوچک میتوانند از طریق تعامل مداوم انسان و هوش مصنوعی به سوگیریهای بسیار بزرگتری تبدیل شوند.

در این مطالعه، این اثر تقویتشده به طور قابل توجهی قویتر از آن چیزی بود که در تعامل انسانها با یکدیگر مشاهده میشود، که نشان میدهد موضوعی خاص در نحوه پردازش و درونیسازی اطلاعات تولیدشده توسط هوش مصنوعی وجود دارد.

پروفسور تالی شارات، یکی از نویسندگان اصلی این تحقیق گفت: «آدمها به ذات سوگیر و متعصب هستند، بنابراین وقتی سیستمهای هوش مصنوعی را با دادههایی که توسط انسانها تولید شدهاند آموزش میدهیم، الگوریتمهای هوش مصنوعی سوگیریهای انسانی که در دادهها نهفته است، میآموزند. هوش مصنوعی تمایل دارد که این سوگیریها را به منظور بهبود دقت پیشبینی خود تقویت کند.»

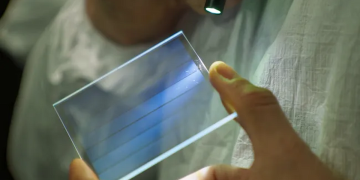

فرض کنید که پزشکی از یک سیستم هوش مصنوعی برای تشخیص بیماریها از روی تصاویر پزشکی استفاده میکند. اگر این سیستم حتی کمی سوگیری داشته باشد، پزشک ممکن است بدون اینکه خود بداند این سوگیریها را در تصمیمهای خود اعمال کند. وقتی هوش مصنوعی از این تصمیمها یاد میگیرد، قضاوتهای انسان و ماشین به مرور زمان بیشتر و بیشتر تحت تأثیر این سوگیریها قرار میگیرند.

محققان این پدیده را از طریق چندین آزمایش بررسی کردند. در یکی از آزمایشها، از شرکتکنندگان درخواست شد که به مجموعهای از ۱۲ چهره که به مدت نیم ثانیه نمایش داده میشدند، نگاه و قضاوت کنند که آیا چهرهها شاد یا غمگین به نظر میرسند.

شرکتکنندگان اولیه کمی سوگیری از خود نشان دادند و ۵۳ درصد مواقع چهرهها را غمگین تشخیص دادند. وقتی که یک برنامه کامپیوتری به نام Convolutional Neural Network (که مشابه مغز انسان تصاویر را پردازش میکند) بر اساس این قضاوتهای انسانی آموزش دید، این سوگیری به طور قابل توجهی تقویت شد و ۶۵ درصد مواقع چهرهها را غمگین طبقهبندی کرد.

وقتی شرکتکنندگان جدید با این سیستم هوش مصنوعی سوگیریدار تعامل برقرار کردند، آنها دیدگاههای تحریفشده سیستم را پذیرفتند. اعداد نشان میدهند که وقتی شرکتکنندگان با قضاوت هوش مصنوعی مخالف بودند، حدود یکسوم مواقع (۳۲.۷۲ درصد) نظر خود را تغییر دادند. در مقایسه، وقتی همین افراد با دیگر انسانها تعامل داشتند، تنها ۱۱.۲۷ درصد مواقع نظرات خود را تغییر دادند. این نشان میدهد که افراد سه برابر بیشتر از تعامل با انسانها، تحت تأثیر قضاوت هوش مصنوعی قرار میگیرند.

این اثر تقویت سوگیری در فعالیتهای مختلف مشاهده شد. به جز تشخیص چهره، افراد در آزمونهایی شرکت کردند که جهت حرکت نقاط روی صفحه را مورد ارزیابی قرار میدادند. همچنین عملکرد دیگران را بررسی میکردند. پژوهشگران متوجه شدند که شرکتکنندگان بعد از استفاده از سیستم هوش مصنوعی دارای سوگیری جنسیتی، بیشتر تمایل داشتند که عملکرد مردان را به شکلی نادرست قضاوت کنند.

دکتر موشه گلیکمن یکی از نویسندگان تحقیق عنوان کرد: «انسانهایی که سوگیری دارند، باعث میشوند که هوش مصنوعی هم سوگیر شود. سیستمهای هوش مصنوعی با سوگیری میتوانند باورهای افراد را تغییر دهند، به طوری که افراد استفادهکننده، بیشتر سوگیر شوند. این سوگیری شامل قضاوتهای اجتماعی و حتی ادراکات پایهای آنها میشود.»

محققان برای نشان دادن تأثیرات واقعی، یک سیستم تولید تصویر هوش مصنوعی به نام Stable Diffusion را آزمایش کردند. وقتی از این سیستم خواسته شد که تصاویری از مدیران مالی ایجاد کند، سیستم تعصب شدیدی نشان داد و ۸۵ درصد مواقع تصاویری از مردان سفیدپوست تولید کرد، که این میزان بسیار بیشتر از جمعیت واقعی بود.

پس از دیدن این تصاویر، شرکتکنندگان به طور قابل توجهی بیشتر تمایل داشتند که نقش یک مدیر مالی را با مردان سفیدپوست مرتبط کنند، که نشان میدهد چگونه سوگیریهای هوش مصنوعی میتوانند ادراکات انسانی از نقشهای اجتماعی را تغییر دهند.

وقتی به افراد داخل تحقیق گفته شد که با شخص دیگری در حال تعامل هستند، نه با هوش مصنوعی، سوگیریها را کمتر میپذیرفتند. پژوهشگران میگویند که این موضوع شاید به این دلیل باشد که مردم فکر میکنند هوش مصنوعی در برخی کارها دقیقتر از انسانها است و وقتی بدانند که با ماشین کار میکنند، بیشتر تحت تأثیر قضاوت هوش مصنوعی قرار میگیرند.

این یافتهها نگرانکننده است، چرا که امروزه مردم به طور فزایندهای با محتوای تولیدشده توسط هوش مصنوعی در زندگی روزمره خود مواجه میشوند. از رسانههای اجتماعی گرفته تا الگوریتمهای استخدامی و ابزارهای تشخیص پزشکی، سیستمهای هوش مصنوعی به طور فزایندهای بر ادراکات و تصمیمات انسانی تأثیر میگذارند.

محققان میگویند که کودکان ممکن است بیشتر از بقیه افراد جامعه در برابر این تأثیرات آسیبپذیر باشند، چرا که باورها و ادراکات آنها هنوز در حال شکلگیری است.

اما همه تحقیقات در این زمینه بد نیستند. وقتی انسانها با سیستمهای هوش مصنوعی دقیق و بیطرف کار میکنند، قضاوتهای آنها بهتر میشود.

دکتر گلیکمن تأکید کرد: «مهم است بدانیم که کار با هوش مصنوعی دقیق میتواند قضاوتهای افراد را بهبود بخشد، پس باید سیستمهای هوش مصنوعی را برای دقت و بیطرفی بیشتر تقویت کنیم.»

سوگیری در هوش مصنوعی یک مسیر یکطرفه نیست، بلکه دایرهای است که در آن سوگیریهای انسان و ماشین روی هم تأثیر میگذارند. برای ادغام هوش مصنوعی در حوزههای مختلف مانند: سلامت و عدالت، درک این تعامل پویا بسیار مهم است.