شرکت انویدیا با هدف حذف گلوگاه تاخیر در هوش مصنوعی عاملمحور، واحدهای LPU متعلق به Groq را به عنوان شتابدهنده مرحله رمزگشایی (Decode) در معماریهای نسل آینده و رکهای مقیاسبزرگ خود ادغام میکند.

به گزارش سرویس سختافزار تکناک، در حالی که انویدیا با معماریهای Hopper و Blackwell بازار «آموزش» مدلهای بزرگ زبانی را در اختیار دارد، اما با ظهور مدلهای عاملمحور (Agentic AI)، چالش جدیدی به نام «تأخیر» (Latency) ظهور کرده است. برنامه جدید انویدیا هدف قرار دادن همین گلوگاه است.

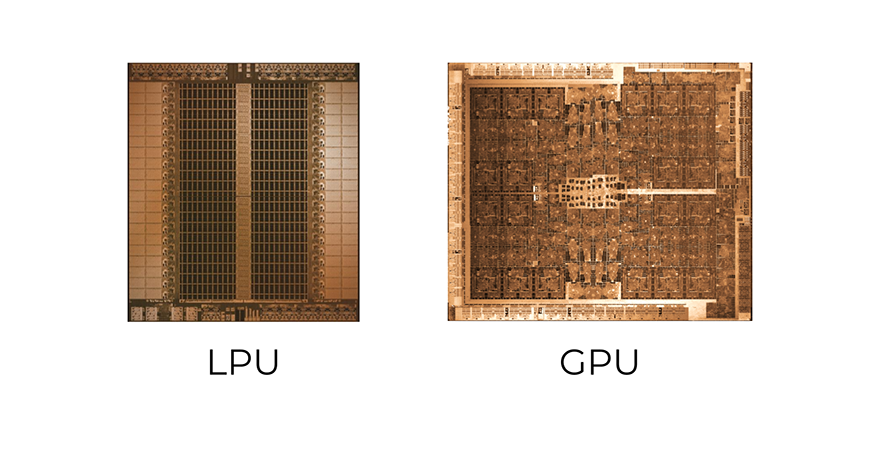

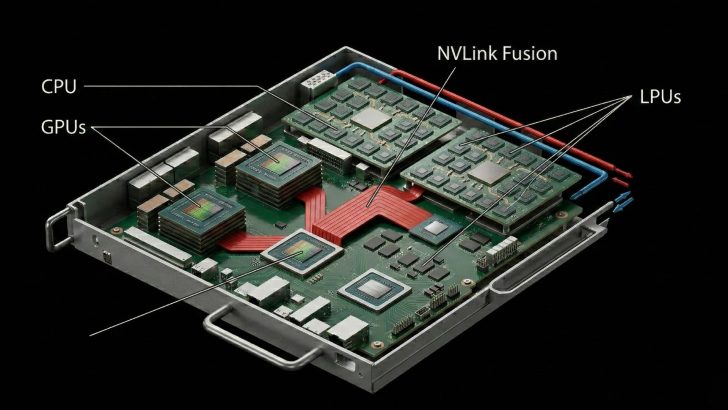

در معماریهای جدید، مرحله Decode (رمزگشایی) که مسئول تولید پاسخهای فوقسریع در محیطهای چندعاملی است، اهمیت حیاتی یافته است. انویدیا قصد دارد با ادغام واحدهای LPU که از پهنای باند داخلی خیرهکننده (دهها ترابایت بر ثانیه) بهره میبرند، پاسخگویی مدلها را از چند دقیقه به چند ثانیه کاهش دهد.

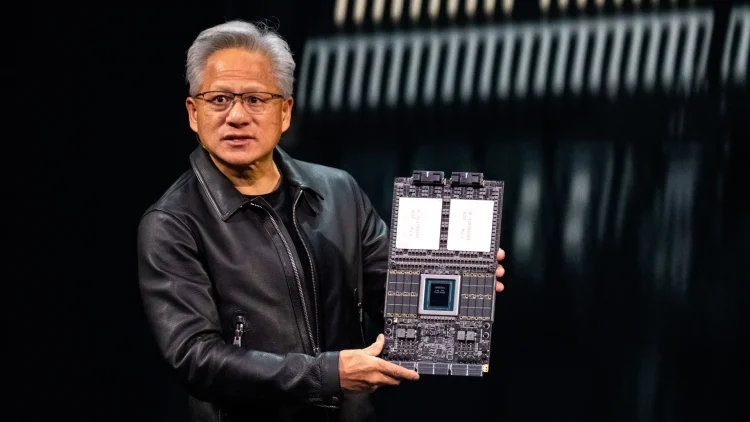

wccftech مینویسد، هوانگ در اظهارنظری کلیدی، خرید Groq را با خرید تاریخی شرکت Mellanox مقایسه کرد. همانطور که Mellanox با حل چالشهای شبکه و معرفی پروتکل InfiniBand، استراتژی دیتاسنترهای انویدیا را متحول کرد، Groq نیز قرار است معماری انویدیا را در سطح «تراشه و رک» گسترش دهد. این به معنای آن است که انویدیا تنها به دنبال یک تراشه نیست، بلکه به دنبال یک سیستم یکپارچه برای مدیریت حجمهای کاری حساس به تأخیر است.

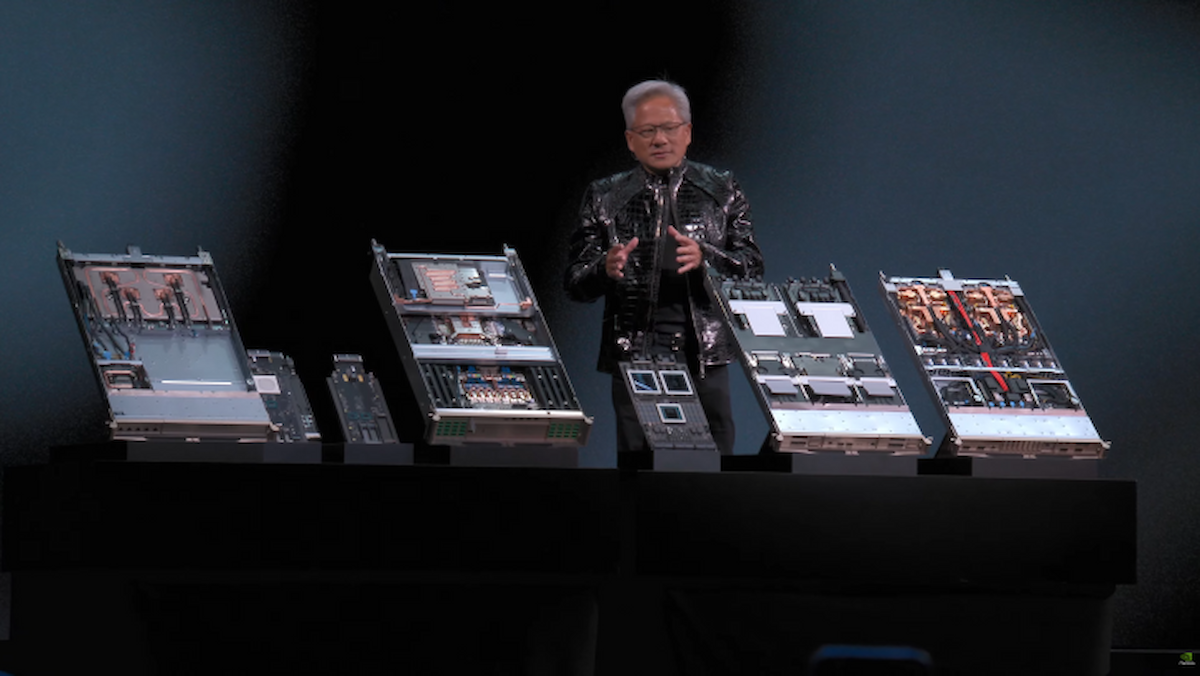

بر اساس تحلیلهای مؤسسه GF Securities، انتظار میرود انویدیا در کنفرانس GTC امسال از محصولی تحت عنوان LPX Rack رونمایی کند. این واحد پردازشی غولپیکر احتمالاً میزبان ۲۵۶ واحد LPU خواهد بود که از طریق پروتکلهای پیشرفتهای نظیر NVLink Fusion به پردازندههای گرافیکی (GPU) متصل میشوند تا عملیات سنگین KV Cache را مدیریت کنند.

مدیرعامل انویدیا تایید کرد که درآمد و توان محاسباتی این شرکت اکنون با نسبت ۱:۱ در حال رشد است؛ تغییری که مستقیماً تحت تأثیر تکامل تهاجمی «لایه کاربردی» هوش مصنوعی قرار دارد. با ورود تراشههای Feynman و ادغام هیبریدی LPUها، انویدیا خود را برای فصلی جدید آماده میکند که در آن سرعت پاسخگویی، به اندازه قدرت پردازش اهمیت خواهد داشت.