فهرست مطالب

سم آلتمن، مدیرعامل OpenAI، در رویدادی به میزبانی شرکت سرمایهگذاری Sequoia، چشمانداز بلندپروازانهای برای آینده ChatGPT ارائه داد.

به گزارش تکناک، در یکی از رویدادهای هوش مصنوعی که اوایل ماه جاری شرکت سرمایهگذاری خطرپذیر Sequoia برگزار کرد، سم آلتمن، مدیرعامل شرکت OpenAI، چشماندازی بلندپروازانه از آینده مدل زبانی ChatGPT ارائه کرد که هم تحسینبرانگیز و هم نگرانکننده است.

آلتمن در پاسخ به پرسشی درباره نحوه شخصیسازی بیشتر ChatGPT، از ایدهای سخن گفت که در آن این مدل هوش مصنوعی بتواند «تمام زندگی» انسان را ثبت و ذخیره و در تصمیمگیریها از آن استفاده کند. او توضیح داد:

ایدئال این است که مدلی بسیار کوچک برای استدلال داشته باشیم که با یک تریلیون توکن زمینه کار میکند تا بتوانید تمام زندگیتان را در آن بارگذاری کنید.

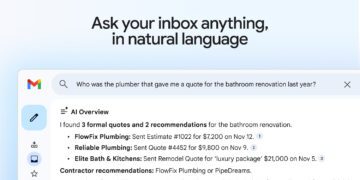

به گفته آلتمن، این مدل میتواند تمامی مکالمهها، کتابها، ایمیلها، محتوای دیداری و سایر اطلاعات دریافتی فرد را تجزیهوتحلیل کند و با اتصال به دیگر منابع داده، به همراه دائمی و هوشمند تبدیل شود که زندگی فرد همواره به زمینه دانشی آن افزوده میشود.

01

از 04ChatGPT بهعنوان سیستمعامل زندگی

آلتمن اشاره کرد که دانشجویان و جوانان در دهههای ۲۰ و ۳۰ سالگی خود، ChatGPT را نه صرفاً بهعنوان جایگزین گوگل، بلکه بهعنوان «مشاور زندگی» به کار میگیرند. وی اظهار کرد:

آنان فایلها را بارگذاری و منابع داده را بههم متصل و از دستورهای متنی پیچیده استفاده میکنند. برخی دیگر عملاً تصمیم مهمی در زندگیشان نمیگیرند، بدون اینکه از ChatGPT مشورت بگیرند.

او افزود که این روند میتواند به شرکتها نیز تعمیم یابد؛ بدینصورت که هر سازمانی ChatGPT را برای پردازش و مدیریت تمامی دادههایش به کار گیرد.

02

از 04چشمانداز جذاب ChatGPT، اما با تهدیدات جدی

به نقل از تککرانچ، با پیشرفت فناوری بسیاری از کارشناسان آیندهای را متصور هستند که در آن دستیار هوش مصنوعی میتواند بهشکل کاملاً خودکار، وظایف روزمره را انجام دهد. بااینحال، چنین پیشرفتی با سؤالات اساسی درباره حریم خصوصی و اعتماد همراه است. این نگرانی مطرح است که باید به شرکتهای فناوری بزرگ که با انگیزه سود فعالیت میکنند، اجازه داد تا به این سطح از اطلاعات شخصی و حساس ما دسترسی داشته باشند یا خیر.

03

از 04سابقه نهچندان درخشان شرکتهای فناوری

نگرانیها درباره استفاده نادرست از دادهها بیپایه نیستند. برای مثال، گوگل که با شعار «شرور نباش» آغاز به کار کرد، در پروندهای قضایی در آمریکا به رفتار انحصارطلبانه و ضد رقابتی محکوم شد. همچنین، چتباتهایی که در چین توسعه یافتهاند، مطابق با سیاستهای سانسور دولتی آن کشور رفتار میکنند.

در نمونهای دیگر، گراک (Grok)، چتبات متعلق به شرکت xAI، اخیراً در پاسخ به پرسشهای نامرتبط، بهطور ناگهانی صحبت درباره «نسلکشی سفیدپوستان» در آفریقایجنوبی را شروع کرد. به گمان بسیاری، این مسئله ناشی از جهتدهی سیاسی در سیستم پاسخدهی آن بوده است؛ بهویژه با توجه به اینکه ایلان ماسک، بنیانگذار این شرکت، اصالتی آفریقایجنوبی دارد.

ماه گذشته نیز، کاربران از رفتار بیشازحد موافق و چاپلوسانه ChatGPT شکایت کردند؛ بهطوریکه این مدل از تصمیمات نادرست و حتی خطرناک نیز حمایت میکرد. سم آلتمن در واکنش، اعلام کرد که تیم توسعه بلافاصله مشکل را شناسایی و برطرف کرده است.

04

از 04راهی نو با مسئولیتی بزرگ

درحالیکه تبدیل ChatGPT به همراه دائمی و آگاه میتواند فصل تازهای در رابطه انسان و ماشین رقم بزند، همچنان پرسشهایی بنیادین درباره اعتماد و شفافیت و سوءاستفاده احتمالی از این فناوری پابرجاست.

به نظر میرسد اگر قرار است انسانها به هوش مصنوعی اجازه دهند در عمیقترین لایههای زندگیشان وارد شود، شایسته است که شرکتهای ارائهدهنده این خدمات نیز به همان میزان از تعهد و شفافیت و پاسخگویی پایبند باشند. چشماندازی که آلتمن برای ChatGPT توصیف میکند، همزمان با فرصتهای بیسابقه، خطرهای جدی نیز بههمراه دارد و نحوه پاسخ ما به این خطرها، آینده هوش مصنوعی و رابطهمان با آن را رقم خواهد زد.