فهرست مطالب

شرکت مایکروسافت با وجود هشدارهای امنیتی، عاملهای هوش مصنوعی را در ویندوز ۱۱ گسترش داده است.

به گزارش سرویس فناوری تکناک، این رویکرد که با دسترسی گسترده عاملهای هوش مصنوعی به فایلها همراه است، نگرانیهای جدی برای حریم خصوصی ایجاد کرده است.

شرکت مایکروسافت طی هفتههای گذشته، آینده ویندوز را با عاملهای هوش مصنوعی گره زده است، اما همزمان اسناد رسمی شرکت هشدار میدهند که این عاملها میتوانند دچار خطا شوند، رفتار غیرمنتظره از خود نشان دهند و حتی قربانی حملاتی شوند که تا یک سال پیش وجود نداشتند. با وجود این اعتراف صریح، شرکت همچنان مسیر توسعه یک سیستمعامل عاملمحور را در ویندوز ۱۱ دنبال میکند.

این تناقض، پرسش مهمی ایجاد کرده است: اگر مایکروسافت از خطرات باخبر است و توصیه میکند که عاملها در حسابهای جداگانه، نشستهای ایزوله و محیطهای کنترلشده اجرا شوند، چرا ویندوز ۱۱ را به بستر آزمایشی چنین فناوری حساسی تبدیل کرده است؟ این پرسش زمانی پررنگتر میشود که کاربران از «هجوم قابلیتهای هوش مصنوعی» به سیستمعامل خسته شدهاند.

بخوانید: خداحافظ کوپایلت؛ تعامل صوتی با هوش مصنوعی در ویندوز بدون دخالت دست میشود

01

از 06قمار بزرگ مایکروسافت روی پردازش عاملمحور آغاز شده است

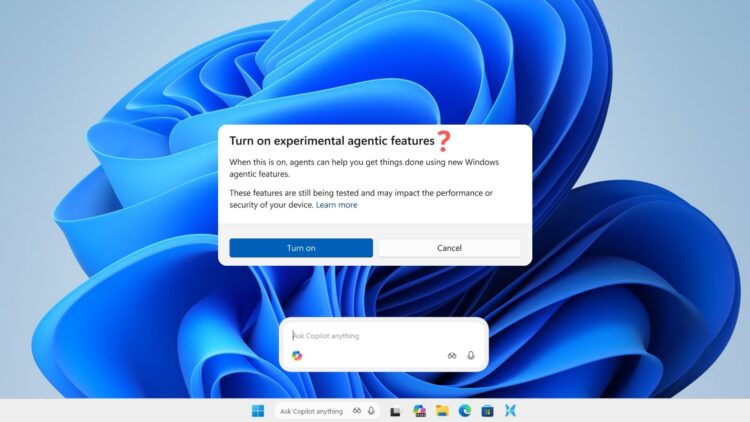

شرکت مایکروسافت در اکتبر ۲۰۲۵ اعلام کرد که «هر رایانه ویندوز ۱۱ یک رایانه مبتنی بر هوش مصنوعی خواهد بود». این اعلام شامل موجی از یکپارچهسازیهای هوش مصنوعی بود، که به کاربران امکان میدهد با رایانه صحبت کنند، به آن نشان دهند روی صفحه چه میبینند و سپس بخواهند بهجای آنها کار انجام دهد. ابزارهایی مانند Copilot Voice، Copilot Vision و Copilot Actions پیشنمایشی از این برنامه هستند.

نوار وظیفه ویندوز اکنون به مرکز عملیات هوش مصنوعی تبدیل شده است. جعبه جستوجوی قدیمی جای خود را به بخش «Ask Copilot» داده است؛ قابلیتی که با یک کلیک، عاملهای هوش مصنوعی را فراخوانی میکند و به آنها اجازه میدهد که به صورت پسزمینهای وظایف را اجرا کنند. این تغییرات، حتی با وجود اختیاری بودن اولیه، نشان میدهد که مایکروسافت راهبرد «سیستمعامل عاملمحور» را نهایی کرده است.

مایکروسافت اعتراف میکند که عاملهای هوش مصنوعی میتوانند رفتار نادرست داشته باشند، اما همچنان آنها را در قلب فایلهای کاربران قرار میدهد.

در اسناد رسمی شرکت آمده است که عاملهای هوش مصنوعی «ممکن است دچار خطا، برداشت اشتباه یا خروجیهای غیرمنتظره شوند». یکی از خطرات مهمی که شرکت به آن اشاره میکند حمله Cross Prompt Injection است. در این وضعیت، عامل هوش مصنوعی بهوسیله محتوای مخرب مخفیشده در رابط کاربری، اسناد یا برنامهها فریب میخورد و دستورالعملهای اولیه خود را کنار میگذارد. این حمله میتواند عامل را وادار کند تا فایلهای حساس را کپی نماید، دادهها را افشا کند یا عملیات ناخواسته انجام دهد.

پژوهشگران امنیتی نیز مدتها است هشدار دادهاند عاملهایی که سطح دسترسی بالا دارند، بهویژه هنگام کنترل نرمافزار از طریق رابط گرافیکی، هدفی آسان برای این نوع حملات هستند.

با وجود این هشدارها، مایکروسافت همچنان به این عاملها دسترسی خواندن و نوشتن در حساسترین فولدرهای سیستم از جمله Documents، Downloads، Pictures، Videos و Desktop را میدهد. شرکت این فولدرها را “known folders” مینامد و معتقد است عاملها برای انجام وظایف خود باید به آنها دسترسی داشته باشند.

پیشنهادی: امکان کنترل دسترسی اپها به هوش مصنوعی در ویندوز ۱۱

02

از 06پشت صحنه گسترش عاملهای هوش مصنوعی در ویندوز

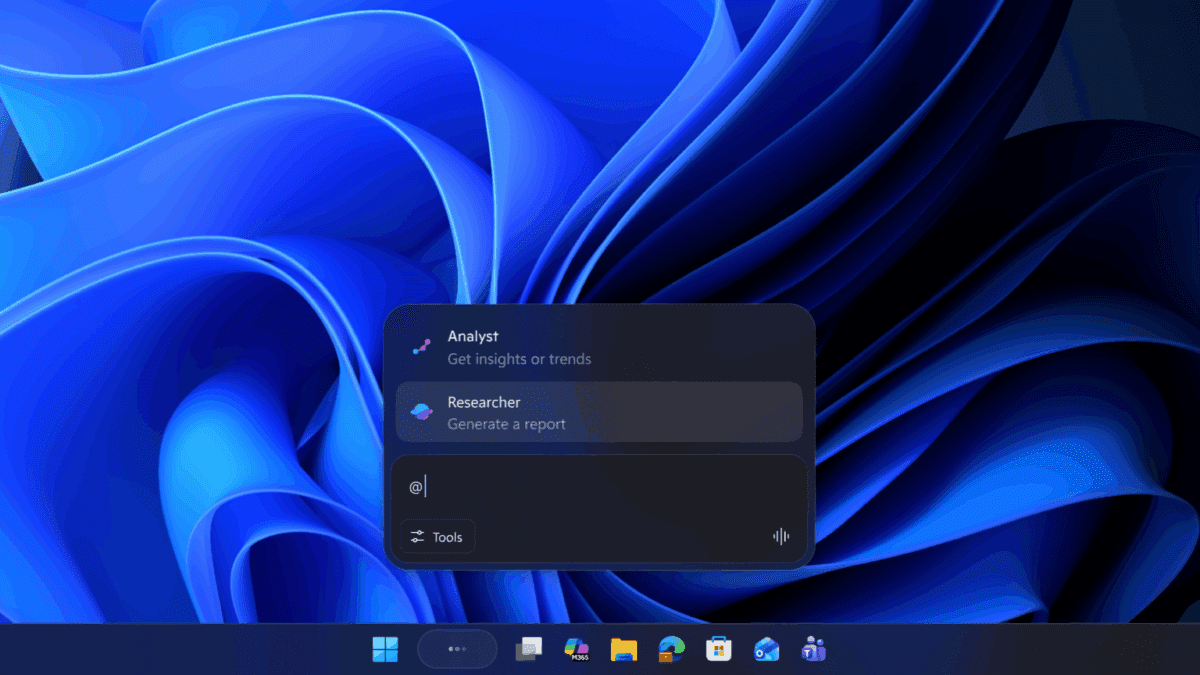

قلب این معماری جدید ویژگی به نام Agent Workspace قرار دارد. این قابلیت محیطی موازی با ویندوز اصلی کاربر ایجاد میکند؛ محیطی که حساب کاربری، دسکتاپ، فرایندها و مرزهای دسترسی مخصوص خود را دارد. برخلاف ماشین مجازی، این فضا بخشی بومی از ویندوز است و هدف آن فراهم کردن مکانی اختصاصی برای فعالیت عاملهای هوش مصنوعی است.

هر عامل هوش مصنوعی یک حساب استاندارد محدود دریافت میکند و اجازه انجام تنها وظایفی را دارد که کاربر فعال کرده است. عاملها در این فضا دقیقاً مانند یک انسان با برنامهها تعامل میکنند: کلیک میکنند، تایپ میکنند، پیمایش میکنند و فایلها را جابهجا میکنند. Copilot Actions نمونهای از کاربرد این مدل است.

هدف از این ساختار، محدود نگهداشتن پیامدهای احتمالی است. اگر یک عامل هوش مصنوعی دچار سوءبرداشت شود یا یک حمله Cross Prompt Injection در داخل سندی فعال شود، آسیب تنها در محدوده Workspace محصور میماند و ویندوز میتواند همه فعالیتها را ثبت و کنترل کند.

این Workspace تنها اطلاعات محدود و فولدرهای شناختهشده را به عامل نشان میدهد. عامل نمیتواند به پوشههای سیستمی، اطلاعات ورود یا فولدرهای داده برنامهها دسترسی داشته باشد؛ مگر اینکه کاربر صریحاً اجازه دهد. ویندوز از Access Control Lists برای جلوگیری از تجاوز عامل به مرزهای تعیینشده استفاده میکند.

03

از 06MCP؛ پلی برای کنترل دامنه فعالیت عاملها

شرکت مایکروسافت پروتکل Model Context Protocol (MCP) را راه ارتباطی استاندارد میان عامل هوش مصنوعی و برنامهها معرفی کرده است. این پروتکل به عامل اجازه میدهد ابزارها را شناسایی کند، توابع فایل را بخواند، سرویسها را کنترل کند و عملیات را تنها از مسیر قانونی ویندوز انجام دهد. MCP مانع دسترسی مستقیم میشود و یک نقطه نظارتی مرکزی ایجاد میکند که هر ابزار و سرویس باید از آن عبور کند.

04

از 06دلیل گسترش عاملهای هوش مصنوعی در ویندوز با وجود ریسکها

بهنظر مایکروسافت عقبنشینی از هوش مصنوعی دیگر امکانپذیر نیست. شرکت میخواهد سیستمعامل به «بومی برای هوش مصنوعی» تبدیل شود. این رقابت زمانی جدیتر میشود که اپل درحال توسعه Apple Intelligence است و گوگل نیز با Aluminium OS برای حضور در بازار رایانه برنامهریزی میکند. همچنین لپتاپ اقتصادی آینده اپل با Apple Intelligence میتواند کاربران بیشتری را جذب کند.

از نگاه مایکروسافت، اگر ویندوز ۱۱ برای آینده عاملمحور آماده نباشد، ممکن است پلتفرمی کسلکننده جلوه کند؛ در حالی که کاربران هماکنون از مشکلات این سیستمعامل، مانند File Explorer کُند، گلایه دارند.

05

از 06سایه سنگین Recall بر آینده عاملمحور مایکروسافت

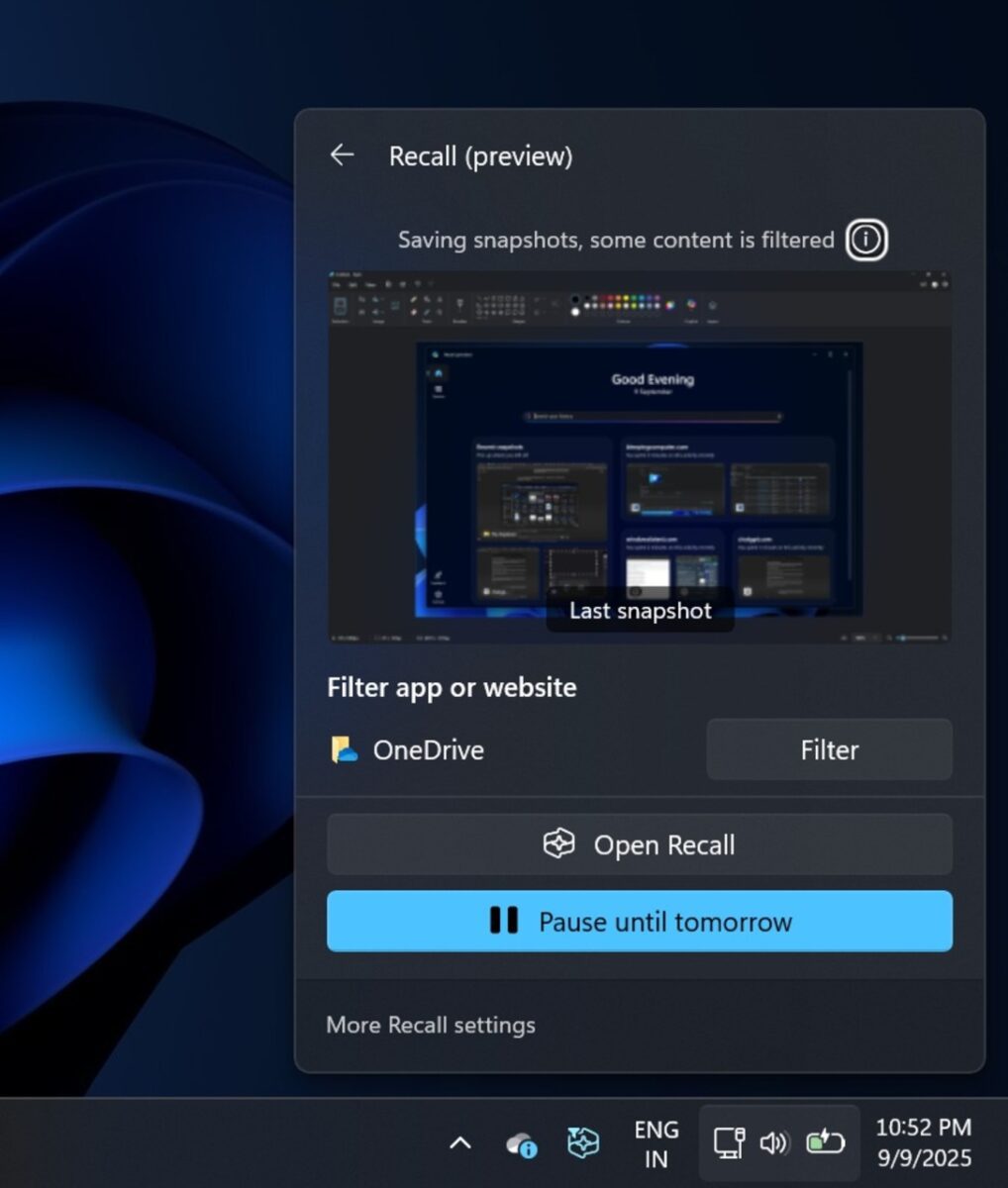

ویژگی Recall نمونهای از عرضه ناموفق در ویندوز بود. این قابلیت که فعالیت کاربر را در قالب اسکرینشات مداوم ذخیره میکرد، موج بزرگی از اعتراض امنیتی و حریم خصوصی ایجاد کرد. شرکت مجبور شد آن را اختیاری و بازطراحی کند، اما همچنان بسیاری Recall را «کابوس حریم خصوصی» میدانند. برنامههایی مانند Signal و Brave حتی قابلیتهایی برای مسدودکردن Recall ارائه دادهاند.

همین تجربه، نگرانی کاربران را از تبدیل ویندوز به یک سیستمعامل عاملمحور تشدید کرده است. پرسش اصلی این است: اگر Recall نتوانست مرزهای حریم خصوصی را رعایت کند، عاملهای هوش مصنوعی که میتوانند کلیک کنند، تایپ کنند و فایل جابهجا کنند، چگونه میتوانند ایمن باشند؟

06

از 06مایکروسافت آیندهای پرریسک میسازد و به همراهی کاربران امید دارد

در نهایت شرکت مایکروسافت تصمیم خود را گرفته است. این شرکت اعتراف میکند که ریسک بالا است، اما همچنان پیش میرود. معماری جدید روی کاغذ منطقی است: حسابهای جداگانه، فضاهای ایزوله، دسترسی کنترلشده، گزارشگیری کامل و یک لایه پروتکل نظارتی، اما واقعیت به اجرا بستگی دارد. یک آسیبپذیری جدی میتواند اعتماد ازدسترفته پس از Recall را بار دیگر از بین ببرد.

پیام واضح است: آینده عاملمحور اجتنابناپذیر است. اما آنچه اجتنابناپذیر نیست، «اعتماد» کاربران است. مایکروسافت برای آن باید بجنگد؛ بهویژه از سوی کاربرانی که احساس میکنند ویندوز ۱۱ علیه آنها کار میکند. شرکت باید همهچیز را اختیاری نگاه دارد و کاربردهای واقعی ارائه دهد تا کاربران بپذیرند که یک عامل هوش مصنوعی در قلب فایلهای شخصی آنها حضور داشته باشد.