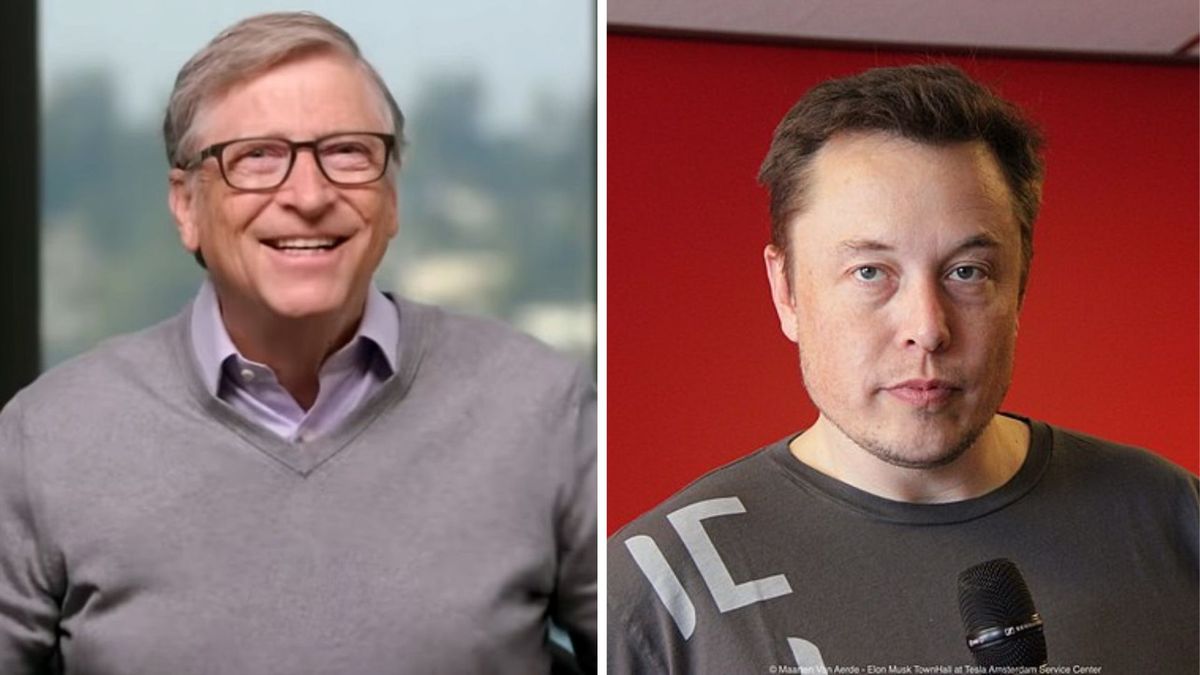

اخیرا در یک پست وبلاگ، بیل گیتس، یکی از بنیانگذاران مایکروسافت، راجب به درخواست ایلان ماسک، مدیرعامل تسلا، برای توقف موقت پیشرفتهای هوش مصنوعی (AI) صحبت کرد.

به گزارش تکناک، گیتس اعتراف کرد که استفاده از هوش مصنوعی خطرات واقعی را به همراه دارد اما همچنین گفت که آنها قابل کنترل هستند.

ماسک یکی از منتقدان سرسخت استقرار هوش مصنوعی و یکی از امضاکنندگان مشهور نامهای بود که در اوایل ماه مارس امسال خواستار توقف شش ماهه تحقیقات هوش مصنوعی شده بود.

گیتس که شرکت مایکروسافت او یکی از پیشتازان ارائه مدلهای هوش مصنوعی مانند GPT-4 برای کاربران است، درخواست ماسک را رد کرده بود. با این حال، این باعث نشد که این مرد 67 ساله در پست طولانی وبلاگ خود درباره خطرات هوش مصنوعی صحبت نکند.

خطرات هوش مصنوعی واقعی است

بیل گیتس به بررسی نتایج ترسناک مختلف استفاده روزانه از هوش مصنوعی پرداخت.به گفته گیتس، اسناد جعلی که ادعا میکنند یک نامزد خاص در انتخابات پیروز شده است یا فردی که با جعل صدای فرزند خود که ادعا میکند او ربوده شده است، همه در محدوده امکاناتی هستند که میتوان با فناوری موجود امروزی اجرا کرد.

او همچنین اشاره کرد که برخی از کارگران به بازآموزی نیاز خواهند داشت زیرا مشاغل تحت تسلط هوش مصنوعی قرار می گیرد، در غیر این صورت خطر جا ماندن آنها وجود دارد. گیتس برای مقایسه می گوید زمان گذار به داده پردازها و متداول شدن کامپیوتر های شخصی در ادارات نیروی کار این تغییر را به یکباره نپذیرفت.

گیتس در بررسی آشکار پیشنهاد ماسک گفت که این تغییرات دلیلی برای توقف پذیرش فناوری نیست. در عوض، آنها باید بیشتر مورد بررسی قرار می گرفتند زیرا هکرها و کشورهای متخاصم کار خود را متوقف نمی کردند و به استفاده از هوش مصنوعی برای اهداف خود ادامه می دادند.

جالب اینجاست که ماسک اخیراً برنامههای خود را برای راهاندازی یک شرکت هوش مصنوعی فاش کرده است.

آماده شدن برای انتقال

گیتس وقتی قدرت هوش مصنوعی را با تسلیحات هستهای مقایسه کرد، از مواضع خود کوتاه نیامد. با بیان اینکه یک جنگ هسته ای همه جانبه برای نسل او نگران کننده بود، اقداماتی مانند پیمان منع اشاعه گسترش صلاح های هسته ای اگرچه ناقص بود اما در جلوگیری از آن موفق بود. او از خوانندگان خواست که به تاریخ نگاه کنند تا در هنگام برخورد با فناوری های جدید ما را راهنمایی کنند.

مدیر عامل سابق مایکروسافت همچنین پیشنهاد کرد که دولت ها باید به فکر ایجاد یک نهاد جهانی برای بررسی مسائل هوش مصنوعی باشند، درست مانند آژانس بین المللی انرژی اتمی که برای همکاری هسته ای ایجاد شده است.

دولت ها و سیاستمداران باید در زمینه هوش مصنوعی تخصص داشته باشند تا بتوانند قوانین و مقرراتی را در اطراف خود وضع کنند تا روند گذار برای جامعه به طور کلی هموار شود.

گیتس افزود: هوش مصنوعی می تواند برای مقابله با اثرات سوء هوش مصنوعی نیز مورد استفاده قرار گیرد. برای مثال، هوش مصنوعی میتواند اسناد جعلی را شناسایی کند که اینتل و دارپا روی آن کار میکنند.

گیتس همچنین معتقد است که معلمان به جای نگرانی در مورد نتایج یادگیری در کودکان به دلیل استفاده از مدلهای هوش مصنوعی، باید از آن به عنوان ابزار کمک آموزشی استفاده کنند که دانشآموزان به آن دسترسی دارند و مطالب آموزشی و تکالیف را پیرامون آن طراحی کنند.

در کل، گیتس به مردم توصیه کرد که در این نوآوری متحول کننده در طول زندگی ما شرکت کنند و دانستن مزایا و خطرات این فناوری، به طور کلی، بحث سالمی را در مورد آن ایجاد می کند.