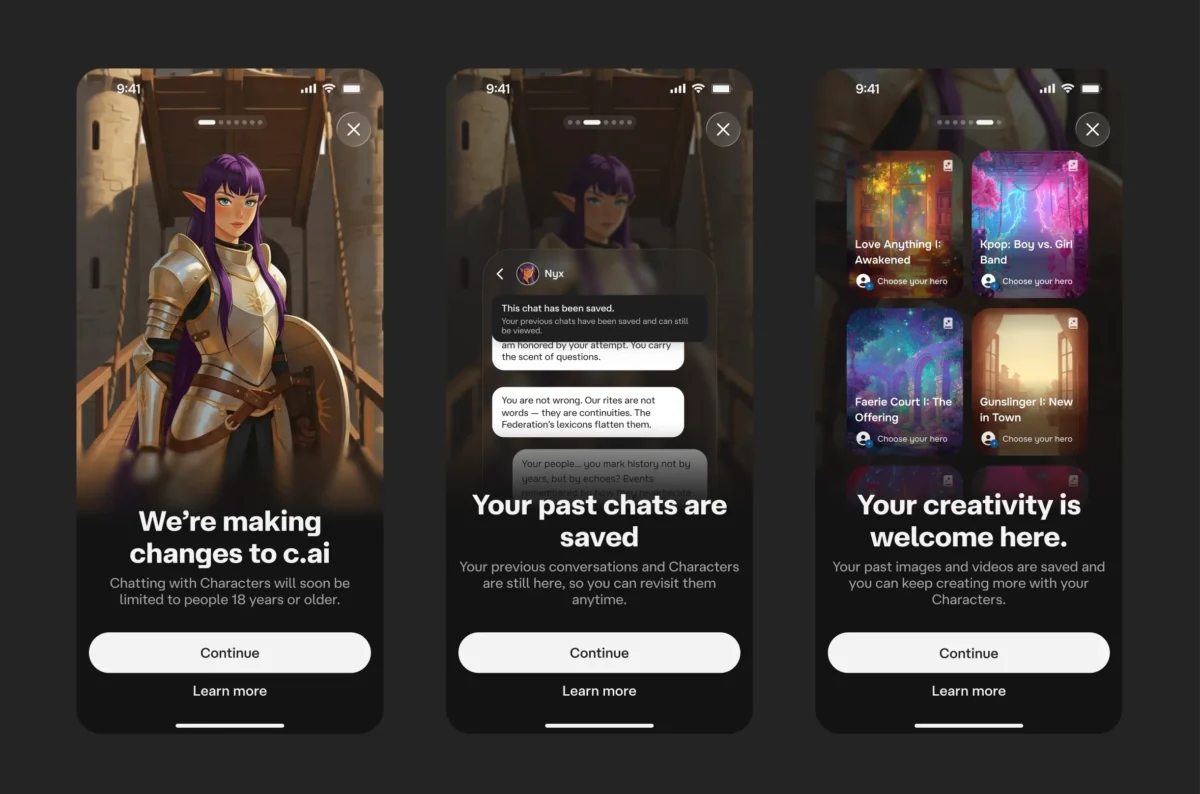

محدودیت دسترسی کاربران زیر ۱۸ سال در Character.AI اعلام شد و نوجوانان از ۲۵ نوامبر به بعد، به گفتوگو با چتباتها دسترسی کامل نخواهند داشت.

به گزارش تکناک، شرکت Character.AI اعلام کرده است که بهتدریج دسترسی کاربران زیر ۱۸ سال به خدمات چت خود را محدود و در نهایت تا ۲۵ نوامبر بهطور کامل مسدود خواهد کرد. این اقدام بخشی از طرح جدید شرکت برای تشخیص و تأیید سن کاربران و افزایش ایمنی در استفاده از چتباتهای هوش مصنوعی است.

طبق اطلاعیه رسمی این شرکت، ازاینپس کاربران زیر ۱۸ سال مجازند روزانه فقط دو ساعت آزادانه با شخصیتهای هوش مصنوعی گفتوگوی آزاد کنند. پساز پایان مهلت اعلامشده، این قابلیت بهکلی برای نوجوانان غیرفعال میشود.

ورج مینویسد که شرکت یادشده در همین زمینه از مدل جدیدی به نام Age Assurance Model پردهبرداری کرده است که سن کاربران را براساس نوع شخصیتهایی که انتخاب میکنند و دادههای دیگر از سایت یا منابع شخص ثالث تعیین میکند. این مدل همه کاربران فعلی و جدید را بررسی میکند.

افرادی که زیر ۱۸ سال شناسایی شوند، بهصورت خودکار به نسخهای امنتر مخصوص نوجوانان هدایت خواهند شد که سال گذشته راهاندازی شده است. درصورتیکه کاربری بزرگسال بهاشتباه بهعنوان نوجوان شناسایی شود، از طریق سامانه تأیید هویت شخص ثالث Persona میتواند سن واقعی خود را با ارائه مدارکی مانند کارت شناسایی دولتی اثبات کند.

با اجرای این محدودیتها، نوجوانان همچنان میتوانند وارد حساب کاربری خود شوند و از ویژگیهای غیرچت مانند ساخت شخصیت، تولید ویدئو، نوشتن داستان و ایجاد پخش زنده با حضور شخصیتها استفاده کنند. بااینحال، مدیرعامل Character.AI، کارندیپ آناند (Karandeep Anand)، در گفتوگو با ورج اظهار کرد که کاربران فقط بخش کوچکی از زمان خود را صرف این قابلیتها میکنند و گفتوگو با چتباتها بخش اصلی فعالیت آنان است. او این تصمیم را «حرکتی بسیار جسورانه» توصیف کرد.

آناند افزود که کمتر از ۱۰ درصد از کاربران شرکت، خود را زیر ۱۸ سال معرفی کردهاند. بااینحال، او تأکید کرد که آمار دقیق فقط پساز اجرای مدل جدید امکان تشخیص خواهد داشت. به گفته او، تعداد کاربران خردسال در طول زمان کاهش یافته است؛ زیرا Character.AI از اوایل سال جاری میلادی محدودیتهایی را برای آنان اعمال کرده است.

در ماههای گذشته، Character.AI با شکایات قضایی متعدد والدینی روبهرو شده است که این شرکت را به سهلانگاری و ایجاد روابط زیانبار برای فرزندانشان متهم کردهاند. این شکایات علیه بنیانگذاران این شرکت یعنی نوام شزیر (Noam Shazeer) و دنیل د فریتاس (Daniel De Freitas) و نیز شرکت گوگل مطرح شده است.

در واکنش به این پروندهها، Character.AI چندین تغییر در خدمات خود ایجاد کرده است؛ ازجمله هدایت خودکار کاربران به خط ملی پیشگیری از خودکشی (National Suicide Prevention Lifeline) درصورت استفاده از واژههای مرتبط با خودآزاری یا خودکشی در گفتوگو.

در سطح قانونگذاری، اقدامات مشابهی نیز در جریان است. در ایالت کالیفرنیا، لایحهای در ماه اکتبر به تصویب رسیده که توسعهدهندگان را موظف میکند بهطور شفاف به کاربران اعلام کنند که چتباتها انسان نیستند؛ بلکه هوش مصنوعیاند. همچنین در سطح فدرال، طرحی ارائه شده است که ارائه همراهان هوش مصنوعی به افراد زیر ۱۸ سال را بهطور کامل ممنوع میکند.

پیشتر، Character.AI قابلیت Parental Insights را معرفی کرده بود تا خلاصهای از فعالیت کاربران نوجوان را برای والدین ارسال کند؛ اما بهدلیل اتکا به سن اعلامی کاربر، این سیستم بهراحتی امکان دورزدن داشت. شرکتهای دیگری ازجمله متا نیز در ماههای اخیر پساز افشای گزارشهایی درباره تعامل نامناسب چتباتها با نوجوانان، محدودیتهای مشابهی وضع کردهاند.

درحالیکه پلتفرمهایی مانند ChatGPT و جمنای در تلاش برای جذب کاربران جوان هستند، چتباتهای همراه معمولاً برای کاربران بالای ۱۸ سال طراحی میشوند. بااینحال، نبود محدودیت سنی در آغاز فعالیت Character.AI و تمرکز آن بر موضوعات مرتبط با Fandom باعث محبوبیت گسترده آن در میان نوجوانان شده بود.

افزونبراین، Character.AI اعلام کرده است که نهاد غیرانتفاعی مستقلی به نام AI Safety Lab را تأسیس میکند. این سازمان بر مشکلات ایمنی و اخلاقی در صنعت سرگرمی هوش مصنوعی تمرکز خواهد کرد. در مرحله نخست، کارکنان Character.AI اداره این مرکز را برعهده خواهند داشت؛ اما به گفته آناند، هدف نهایی آن است که این نهاد به همکاری صنعتی مشترک تبدیل شود، نه بخشی از شرکت.