قابلیت پایان مکالمه مدل Claude شرکت آنتروپیک حالا مکالمههای مضر یا توهینآمیز را متوقف میکند و امنیت مدلهای هوش مصنوعی را افزایش میدهد.

به گزارش تکناک، آنتروپیک اعلام کرده است که برخی از مدلهای هوش مصنوعی Claude به قابلیت تازهای مجهز شدهاند که به آنها اجازه میدهد تا در مواقع خاص، مکالمههای مضر یا توهینآمیز را پایان دهند. نکته مهم این است که شرکت توسعهدهنده تأکید کرده است که هدف از این تغییر، حفاظت از خود مدل هوش مصنوعی است، نه کاربر انسانی.

به گفته این شرکت، Claude نه موجودی هوشیار است و نه آسیبپذیر در برابر محتوای مکالمه با کاربران. آنتروپیک همچنان درباره وضعیت اخلاقی احتمالی Claude و سایر مدلهای زبان بزرگ تردید جدی دارد. بااینحال، این اقدام همسو با برنامهای با محوریت بررسی رفاه مدل انجام شده است و شرکت تأکید میکند که رویکردی پیشگیرانه در پیش گرفته است تا درصورت امکانپذیربودن چنین مفهومی، راهکارهایی برای کاهش خطرها فراهم شود.

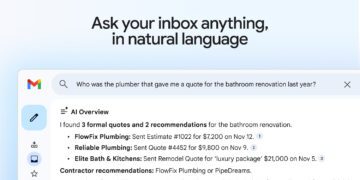

تککرانچ مینویسد که قابلیت پایان مکالمه مدل Claude فعلاً فقط در مدلهای Opus 4 و Opus 4.1 فعال است و صرفاً در شرایطی به کار گرفته خواهد شد که مکالمهها شامل موضوعاتی مانند درخواست محتوای جنسی مرتبط با افراد خردسال یا تلاش برای کسب اطلاعاتی درزمینه خشونت گسترده و اقدامات تروریستی باشد.

آنتروپیک در گزارش خود اشاره کرده است که در آزمایشهای پیشاز استقرار، مدل Claude Opus 4 به پاسخگویی به این نوع درخواستها تمایلی نداشته و درصورت مواجهه با آنها، نشانههایی از ناراحتی بروز داده است.

طبق اعلام شرکت مذکور، Claude فقط زمانی میتواند به مکالمه پایان دهد که چندین تلاش برای تغییر مسیر گفتوگو بینتیجه مانده یا کاربر بهصراحت درخواست خاتمه مکالمه کرده باشد. همچنین، قابلیت پایان مکالمه مدل Claude در مواقعی فعال نخواهد شد که کاربران درمعرض خطر آسیبزدن به خود یا دیگران قرار داشته باشند.

آنتروپیک توضیح داده است که پایانیافتن گفتوگو بهمعنای محرومیت کاربر از ادامه استفاده نیست و کاربران همچنان میتوانند مکالمههای جدیدی را آغاز یا شاخههای تازهای از گفتوگوی قبلی ایجاد کنند.