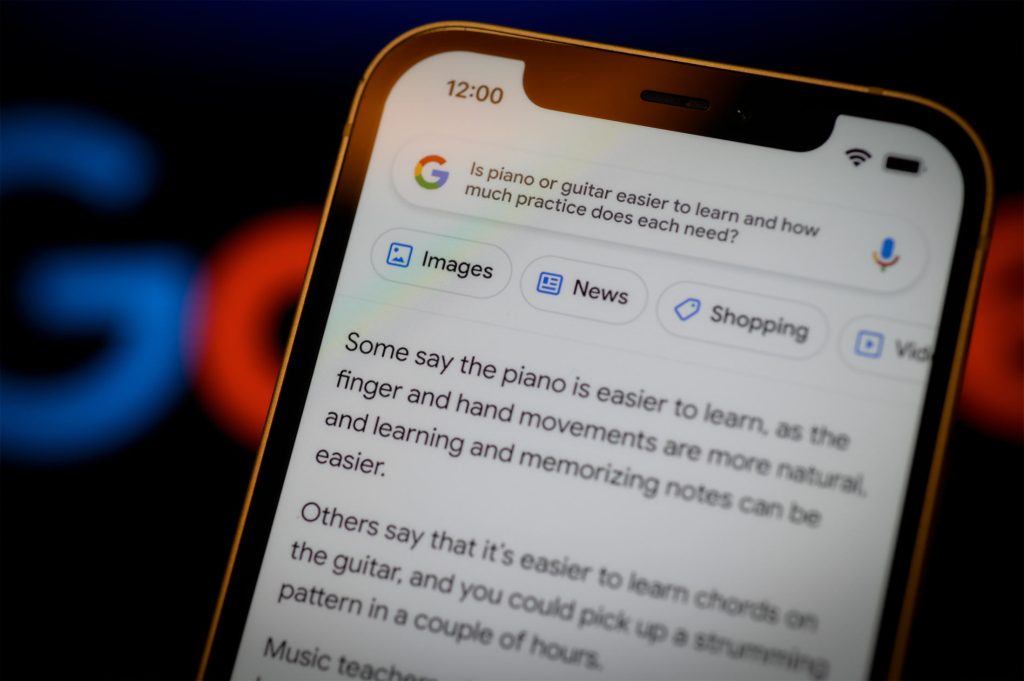

کارمندان گوگل به طور مکرر در پیامهای داخلی از ربات چت گوگل به نام “Bard” انتقاد کردهاند و آن را “دروغگوی ذاتی” خطاب کردهاند. آنها از شرکت خواستهاند که این سیستم را راهاندازی نکند.

به گزارش تکناک، در تلاش برای رقابت با رقبایی مانند مایکروسافت و OpenAI، گوگل عجله کرد تا ربات چت خود را به نام Bard راه اندازی کند. گزارش جدیدی نشان میدهد که کارمندان این شرکت از مدیران خواستند که این محصول را راه اندازی نکند.

این اطلاعات بر اساس یک گزارش چشمگیر از بلومبرگ با استناد به گفتگو با 18 کارمند فعلی و سابق گوگل و همچنین اسکرین شات هایی از پیام های داخلی بین کارمندان این شرکت در مورد این ربات هوش مصنوعی است.

در این گفتگو های داخلی، یکی از کارمندان به این نکته اشاره کرد که بارد به کاربران به طور مکرر توصیههای خطرناک میدهد، چه در موضوعاتی مانند نحوه فرود آوردن یک هواپیما یا غواصی. کارمند دیگری گفت: بارد از بیفایده هم بدتر است: لطفاً آن را راهاندازی نکنید. بلومبرگ گزارش میدهد که شرکت حتی ارزیابی ریسک را که توسط یک تیم ایمنی داخلی ارائه شده بود و میگفت سیستم آماده استفاده عمومی نیست. نادیده گرفته است.با این وجود گوگل، در ماه مارس به صورت آزمایشی دسترسی زودهنگام به ربات “بارد” را فراهم کرد.

گزارش بلومبرگ نشان می دهد که چگونه گوگل ظاهراً نگرانی های اخلاقی را در تلاش برای همگام شدن با رقبایی مانند مایکروسافت و OpenAI کنار گذاشته است. این شرکت اغلب متعهد بودن خود به ایمنی و اخلاق را در هوش مصنوعی تبلیغ می کند، اما مدت هاست که به دلیل اولویت دادن کسب درآمد بر ایمنی و اخلاق در هوش مصنوعی مورد انتقاد قرار گرفته است.

در اواخر سال 2020 و اوایل سال 2021، این شرکت دو محقق به نام تیمنیت گبرو و مارگارت میچل را پس از نگارش یک گزارش تحقیقاتی که نقصهای مدل های زبان هوش مصنوعی را که زیربنای ربات های چتی مانند Bard را برملا میکرد، اخراج کرد. حالا ، با ظهور سیستمهایی هوش مصنوعی که مدل کسب و کار جستجوی گوگل تهدید میکنند، به نظر میرسد که این شرکت بیشتر از قبل بر کسب درآمد از هوش مصنوعی تمرکز دارد تا بر امنیت آن.

همانطور که بلومبرگ بیان میکند، با تعبیر توصیفات کارمندان فعلی و سابق، غول قابل اعتماد جستجوی اینترنتی اطلاعات کیفیت پایینی را در مسابقه ای برای همگام شدن با رقبا در حوزه هوش مصنوعی ارائه می دهد، و تعهد به اخلاق را دیگر در اولویت کارهای خود قرار نداده است.

دیگران در گوگل و به طور کلی در دنیای هوش مصنوعی با این نظر مخالف هستند. یک بحث رایج این است که آزمایش عمومی برای توسعه و محافظت از این سیستم ها ضروری است و آسیب شناخته شده ناشی ربات های چت بسیار ناچیز است.

آنها معتقدند که ممکن است که ربات های چت هوش مصنوعی متون سمی تولید کنند و اطلاعات گمراه کننده ارائه دهند، اما منابع بی شماری دیگر در وب نیز همین کار را می کنند.

رقبای گوگل مانند مایکروسافت و OpenAI نیز میتوانند به اندازه گوگل درگیر باشند. تنها تفاوت این است که آنها در کسب و کار جستجو پیشتاز نیستند و چیزی برای از دست دادن در این حوزه ندارند.

برایان گابریل، سخنگوی گوگل، به بلومبرگ گفت که اخلاق هوش مصنوعی همچنان یکی از اولویتهای برتر شرکت است. گابریل اظهار داشت: ما همچنان در تیمهایی که به کاربرد اصول هوش مصنوعی در فناوری ما کار میکنند، سرمایهگذاری میکنیم.