با انتشار خبر استفاده از دادههای کاربران برای آموزش Claude، آنتروپیک از کاربران خواست برای حفظ حریم خصوصی خود، گزینه مرتبط را غیرفعال کنند.

به گزارش تکناک، آنتروپیک اعلام کرده است که از ۲۸ سپتامبر ۲۰۲۵ آموزش مدلهای هوش مصنوعی خود را برپایه دادههای کاربران ازجمله متنهای گفتوگو و نشستهای کدنویسی آغاز خواهد کرد. این تصمیم فقط شامل کاربرانی میشود که گزینهی انصراف را انتخاب نکنند. طبق اعلام این شرکت، سیاست نگهداری دادهها نیز تغییر کرده و مدتزمان ذخیرهسازی اطلاعات کاربران از دو به پنج سال افزایش یافته است.

براساس گزارش منتشرشده در وبلاگ رسمی آنتروپیک، کاربرانی که روی گزینهی «Accept» کلیک کنند، موافقت خود را با استفاده از دادههایشان برای آموزش مدلها و ذخیرهی آنها تا پنج سال اعلام خواهند کرد. این تغییرات فقط شامل گفتوگوها و نشستهای جدید یا ازسرگرفتهشده خواهد بود و دادههای قبلی که ادامه پیدا نکردهاند، استفاده نخواهند شد.

ورج مینویسد که این سیاست به تمام سطوح اشتراک Claude ازجمله رایگاه و پرو و مکس اعمال میشود؛ اما برای نسخههای تجاری نظیر Claude Gov و Claude for Work و Claude for Education و نیز استفاده از API (ازطریق سرویسهایی همچون Amazon Bedrock و Google Cloud’s Vertex AI) صدق نخواهد کرد.

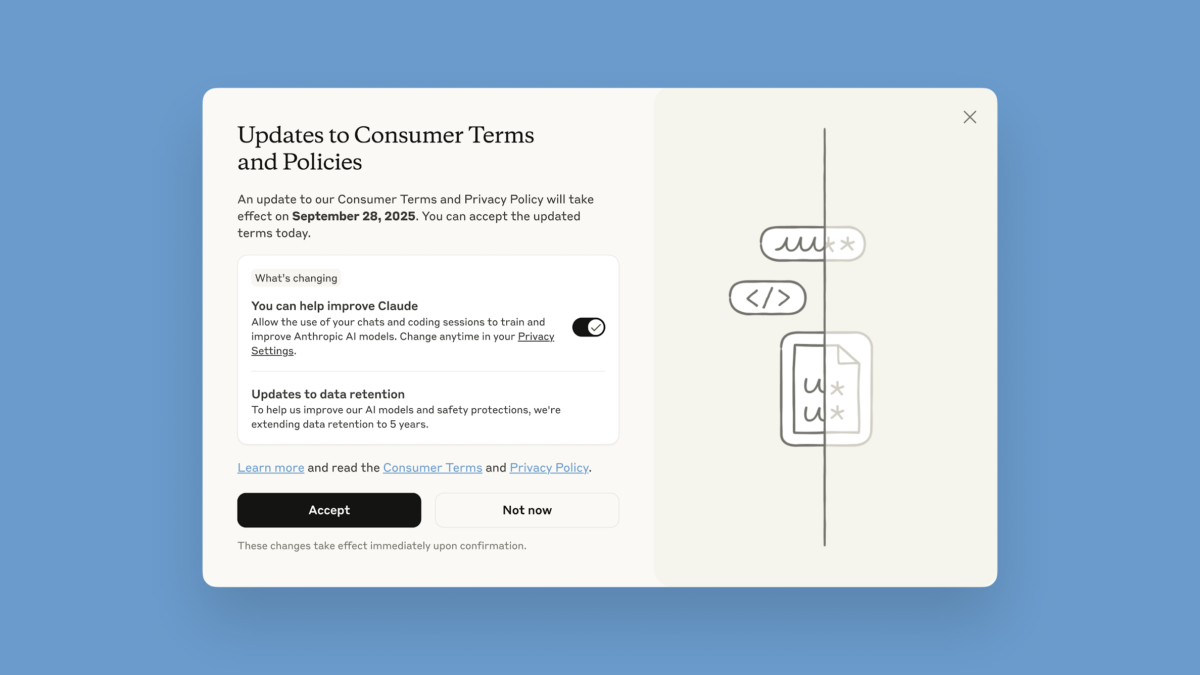

کاربران جدید هنگام ثبتنام در Claude باید ترجیحات خود را مشخص کنند؛ درحالیکه کاربران فعلی ازطریق پنجرهای پاپآپ با عنوان «Updates to Consumer Terms and Policies» به تصمیمگیری ملزم خواهند شد. این پنجره شامل دکمه بزرگ «Accept» و کلید روشنوخاموش است که بهطور پیشفرض روی «On» قرار دارد. بسیاری از کارشناسان هشدار دادهاند که کاربران ممکن است بدون توجه به جزئیات و صرفاً با یک کلیک سریع، شرایط جدید را بپذیرند.

بااینحال، امکان انصراف از این فرایند وجود دارد. کاربران میتوانند کلید را روی حالت «Off» قرار دهند. همچنین درصورت پذیرش اولیه، تغییر تصمیم ازطریق Settings → Privacy → Privacy Settings و غیرفعالکردن گزینه «Help improve Claude» امکانپذیر است. این تغییر فقط برای دادههای آینده اعمال خواهد شد و اطلاعاتی که پیشتر برای آموزش استفاده شدهاند، نمیتوان بازپسگرفت.

کوپایلوت مایکروسافت هم اول بر روی ویندوز و بعد بر روی اندروید این گزینه را فعال کرده است