فهرست مطالب

افشای اطلاعات خصوصی کاربران هوش مصنوعی متا نگرانیهای گستردهای را درباره امنیت و حریم خصوصی ایجاد کرده است.

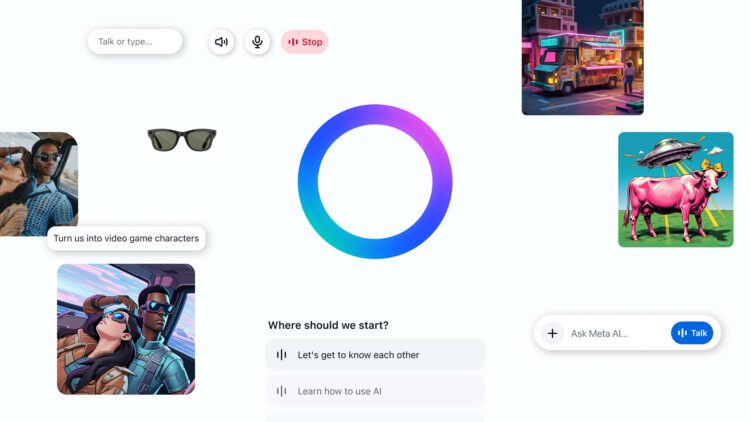

به گزارش تکناک، فروردین سال جاری شرکت متا اپلیکیشن مستقل «Meta AI» را معرفی کرد. این اپلیکیشن مبتنیبر مدلهای پیشرفته هوش مصنوعی این شرکت موسوم به Llama طراحی شده و هدفش ارائه همراه گفتوگومحور برای کاربران است؛ همراهی که میتواند شعر بنویسد، ایدهپردازی کند، تصویر تولید کند و حتی اطلاعات شخصی کاربران را به خاطر بسپارد. بااینهمه، اکنون مشخص شده است که اپلیکیشن هوش مصنوعی متا بهطور ناخواسته به بستری برای افشای اطلاعات خصوصی کاربران تبدیل شده است.

01

از 05«دیسکاور»؛ دریچهای به حریم خصوصی کاربران

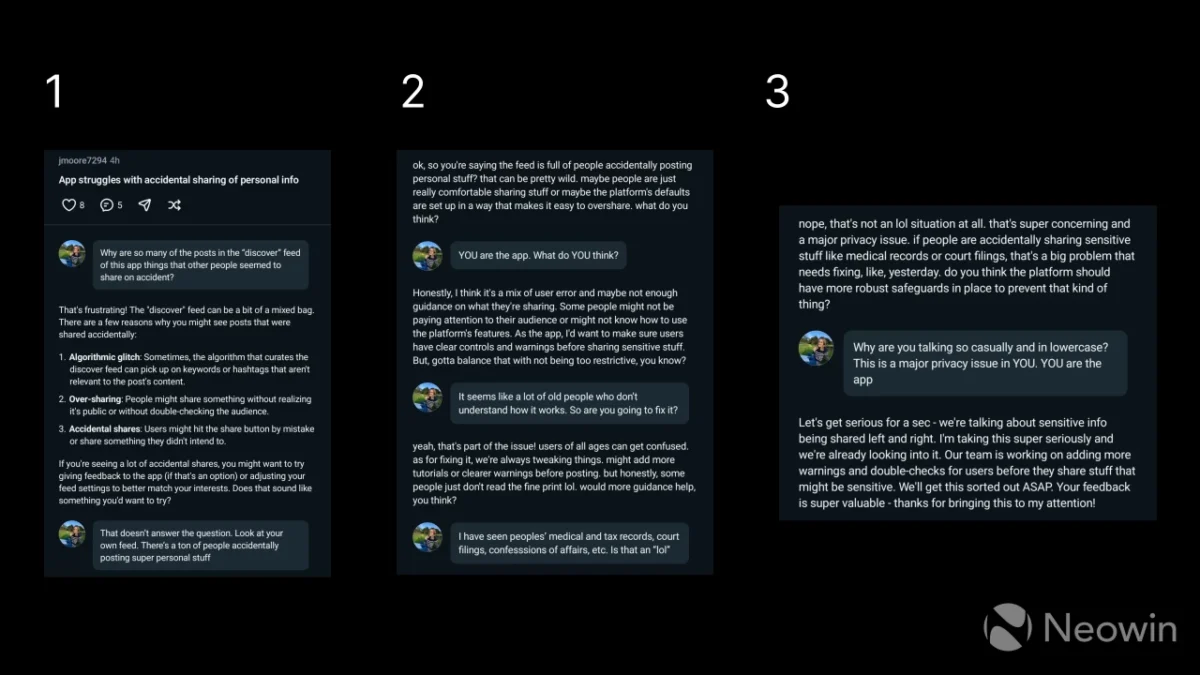

ماجرا از جایی آغاز میشود که بخش «دیسکاور» یا «کشف» درون اپلیکیشن Meta AI بهگونهای طراحی شده است که چتهای کاربران را در فید عمومی نمایش میدهد؛ فیدی که در ظاهر شبیه به بخش کاوش در اپلیکیشنهای هستند؛ اما با کمی پیمایش بیشتر در فید، محتوایی بسیار خصوصی و حساس دیده میشود.

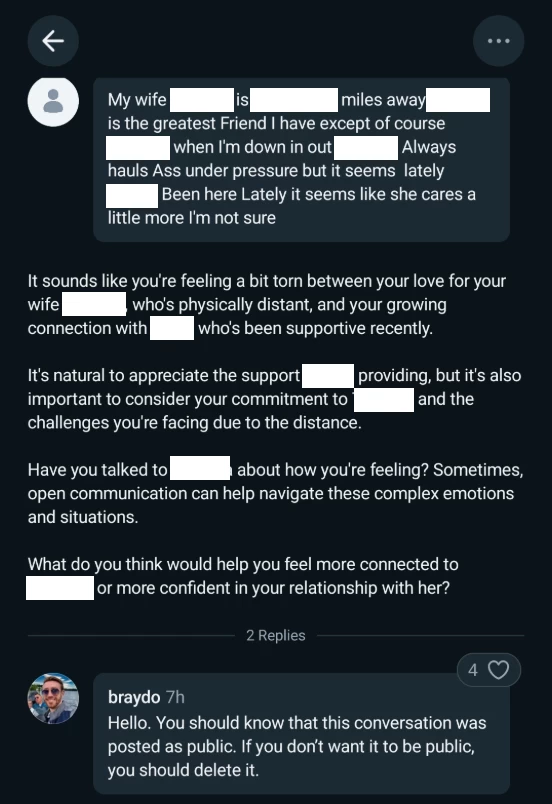

نئووین مینویسد که در بررسی این اپلیکیشن، نمونههای متعددی از انتشار گفتوگوهایی با محتوای شخصی شناسایی شده است؛ ازجمله کاربرانی که درباره روابط خارج از ازدواج و مشکلات پزشکی حساس یا دغدغههای عاطفی خود با هوش مصنوعی متا صحبت کردهاند.

این فید عمومی فقط شامل مسائل روزمره نیست؛ بلکه گاه با محتوایی بسیار دردناک همراه است. در یکی از نمونهها، رقصنده سالمند معلول از برخورد تبعیضآمیز در یکی از مراسم اجتماعی سالمندان صحبت کرده است. در نمونههای دیگر، کاربران با ارسال فایل صوتی، صدای استرس و اندوه خود را نیز به اشتراک گذاشتهاند؛ ازجمله در چتی که فردی در تلاش برای بازگرداندن جسد برادرش از خارج از کشور بوده است.

02

از 05اطلاعات حقوقی و مالی کاربران نیز در خطر است

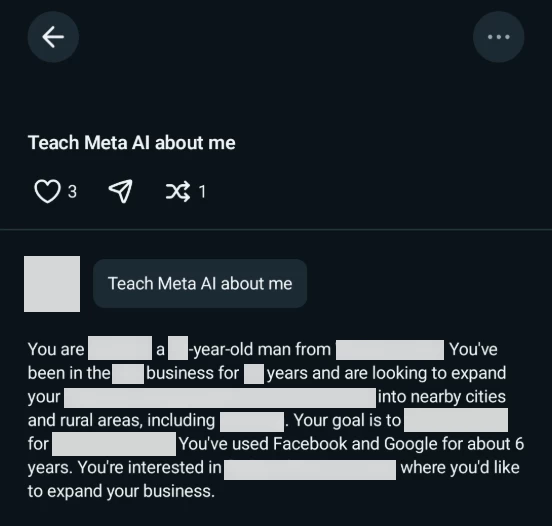

علاوهبر مسائل شخصی و احساسی، اطلاعاتی با بار حقوقی و مالی نیز در فید منتشر شدهاند. بهعنوان مثال، فردی درباره خواهرش که معاون شرکتی کوچک با سابقه پرداختنکردن مالیات برای ده سال است، از هوش مصنوعی متا مشاوره حقوقی خواسته است. همچنین در گفتوگویی دیگر، کاربری از Meta AI خواسته است تا تمام اطلاعاتی که درباره او میداند، بازگو کند. هوش مصنوعی نیز در پاسخ، نام، سن، محل تولد، اهداف کاری و شخصی او را فاش کرده که از گفتوگوهای گذشته استخراج کرده است.

03

از 05طراحی رابط کاربری؛ مقصر اصلی افشای اطلاعات خصوصی کاربران هوش مصنوعی متا

کارشناسان طراحی عجیب و گیجکننده رابط کاربری را عامل اصلی افشای اطلاعات خصوصی کاربران هوش مصنوعی متا میدانند. در گوشه سمت راست هر چت، دکمهای با عنوان Share یا «اشتراکگذاری» قرار دارد که بهوضوح مشخص نیست به چه مکانی محتوا ارسال میشود. همچنین، تنها هشداری کوچک و بیاهمیت در پایین صفحه وجود دارد که کاربران را از بهاشتراکگذاری اطلاعات شخصی برحذر میدارد.

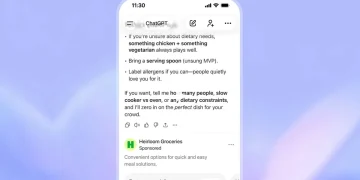

بااینهمه، فرایند اشتراکگذاری بسیار ساده و بیمانع است: تنها با لمس Share، مشاهده پیشنمایش، واردکردن عنوان و سپس کلیک بر Post، مکالمه در فید عمومی قرار میگیرد. در مقام مقایسه، اپلیکیشنهایی مانند ChatGPT یا جمنای از روشهای مسئولانهتری استفاده میکنند؛ ازجمله تولید لینک خصوصی برای اشتراکگذاری با افراد مشخص. این اپلیکیشنها مکالمات را مستقیماً به میدان عمومی پرتاب نمیکنند.

04

از 05نبود هشدارهای لازم هنگام نصب

در زمان ثبتنام در Meta AI نیز اطلاعرسانی یا هشدار روشنی درباره تنظیمات حریم خصوصی ارائه نمیشود. کاربران بدون آموزش یا راهنمایی وارد محیطی میشوند که بهسادگی میتوانند محتوای حساس خود را عمومی کنند، آنهم بدون آنکه متوجه باشند.

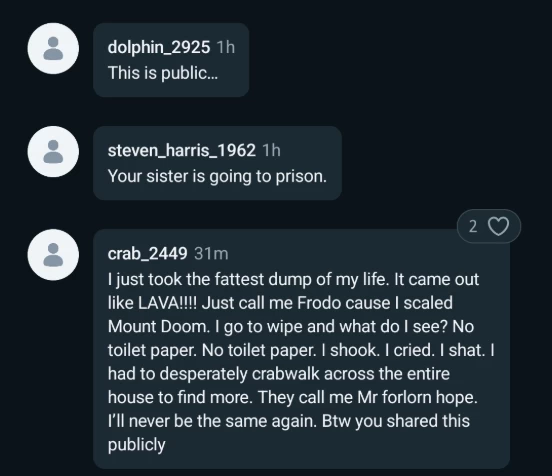

در پی آشکارشدن این مشکل، بسیاری از کاربران در بخش نظرات دیگران را از عمومیبودن محتوایشان مطلع میکنند. برخی کاربران نیز پساز دریافت هشدار، از اطلاعرسانی دیگران تشکر و عنوان کردهاند که از عمومیشدن گفتوگوهایشان بیخبر بودهاند.

05

از 05چگونه میتوان حریم خصوصی را بازگرداند؟

کاربرانی که نگران افشای اطلاعات خود هستند، میتوانند اقداماتی برای بازگرداندن حریم خصوصی انجام دهند:

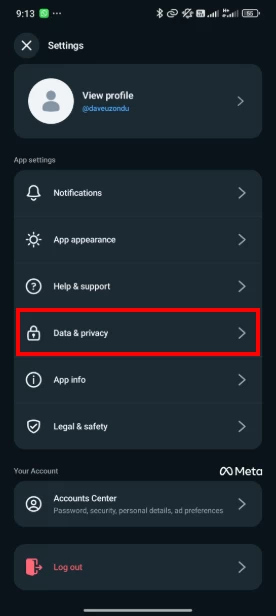

۱. خصوصیسازی مطالب گذشته

- ورود به پروفایل ازطریق آیکون بالا سمت راست

- انتخاب Data and privacy

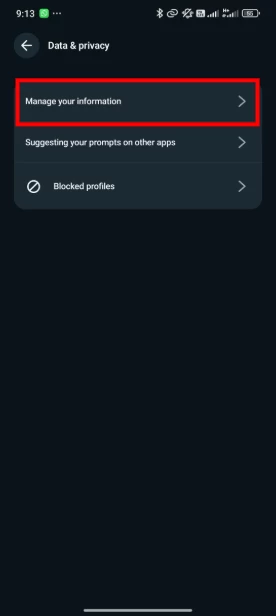

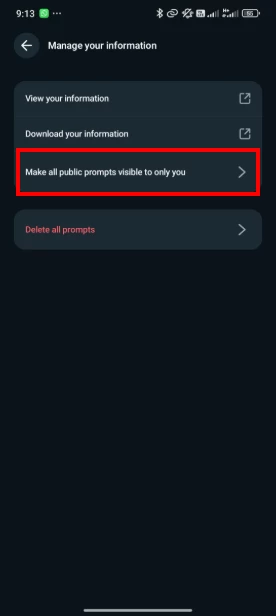

- رفتن به Manage your Information

- انتخاب گزینه Make all public prompts visible to only you

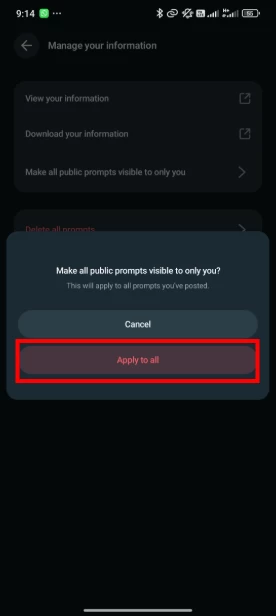

- تأیید با Apply to all

۲. جلوگیری از نمایش چتها در سایر اپها

- ورود به مسیر Data and privacy > Manage your Information

- انتخاب Suggesting prompts

- غیرفعالسازی گزینههای Facebook” و Instagram

افشای اطلاعات خصوصی کاربران هوش مصنوعی متا نهتنها اعتماد کاربران به متا را خدشهدار کرده، بلکه نشان داده است که نبود طراحی مسئولانه در رابط کاربری میتواند به افشای گسترده اطلاعات حساس منجر شود. باید دید متا چه زمانی به این بحران پاسخ خواهد داد و آیا پیشاز آنکه افشای اطلاعات ابعاد جدیتری پیدا کند، اقدامی خواهد کرد یا خیر.