مدل زبان بزرگ SlowFast-LLaVA-1.5 اپل ویدئوهای بلند را با دو جریان پردازش همزمان تحلیل میکند و دقت تصویر و ویدئو را به حداکثر میرساند.

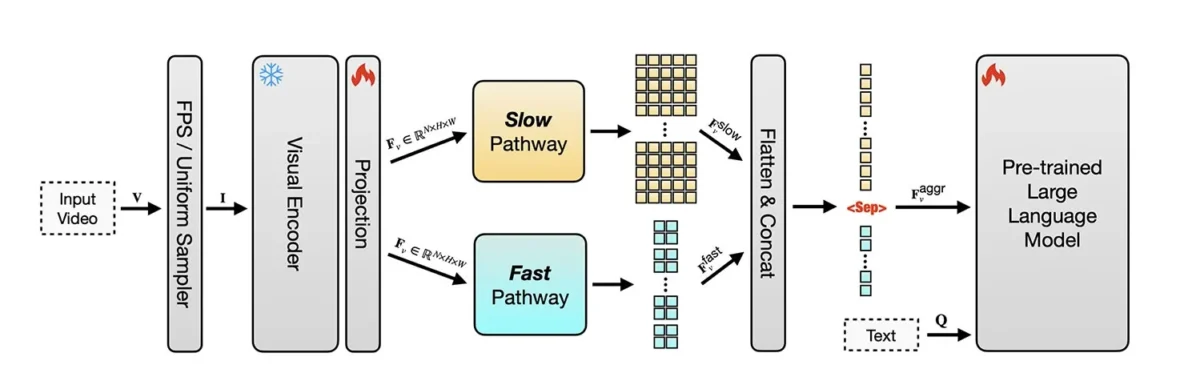

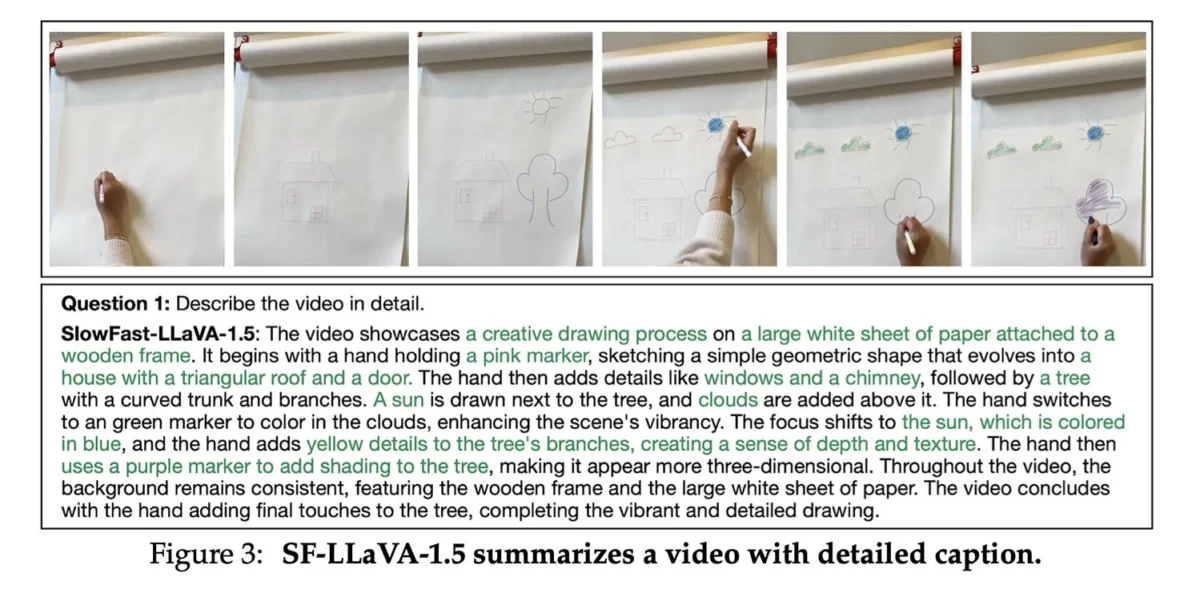

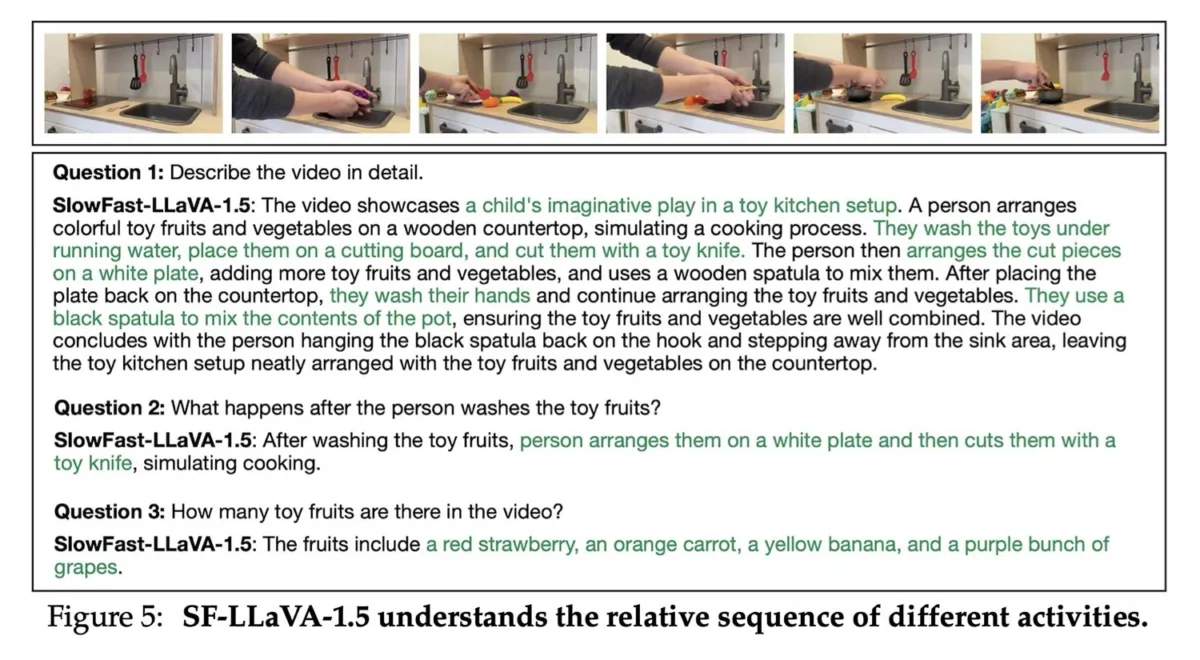

به گزارش تکناک، محققان اپل با معرفی مدل زبان بزرگ جدید SlowFast-LLaVA-1.5، گام بزرگی در مسیر تحلیل و درک ویدئوهای بلند برداشتهاند. این مدل بهطور خاص برای درک و تحلیل ویدیوهای بلند طراحی شده است. مدل SlowFast-LLaVA-1.5 از ترکیب دو جریان مختلف برای پردازش ویدئو استفاده میکند: جریان کُند که به تعداد کمتری از فریمها نگاه و جزئیات بیشتری را استخراج میکند و جریان سریع که به فریمهای بیشتری با جزئیات کمتری توجه دارد. این طراحی باعث میشود تا مدل بتواند بهطور بهینه و کارآمدتر اطلاعات ویدیویی را پردازش کند.

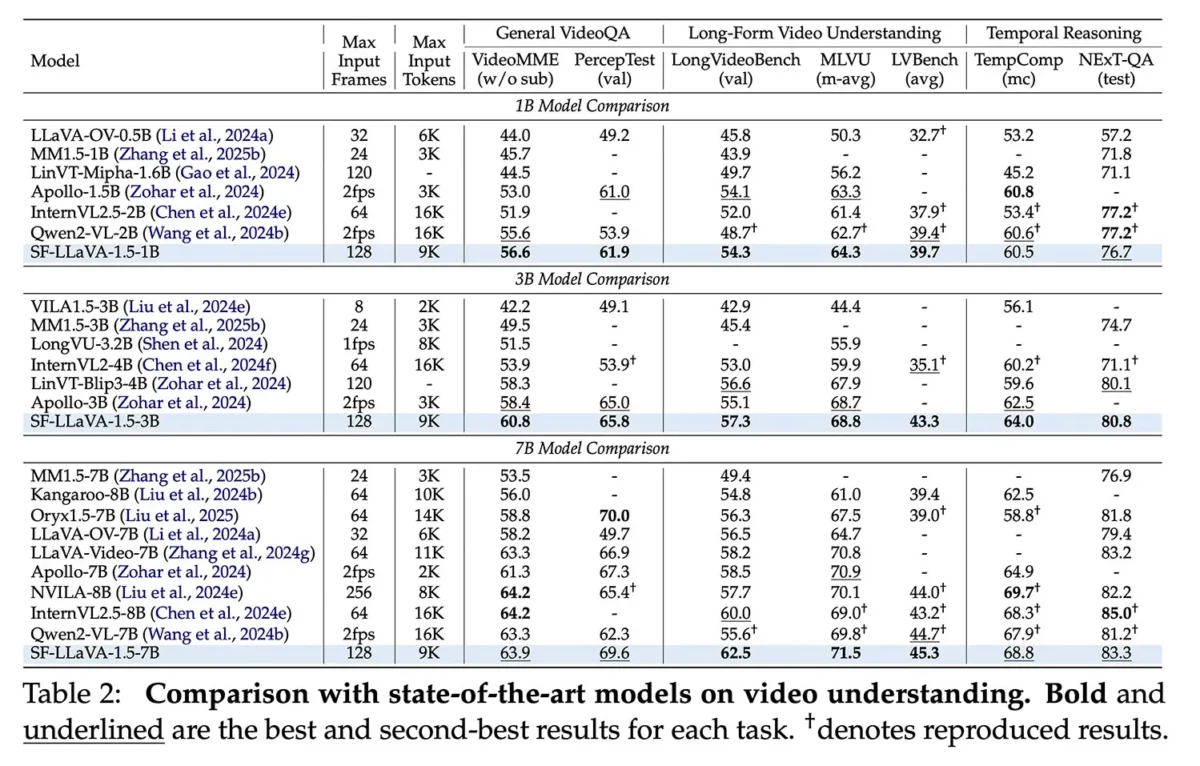

9to5mac مینویسد که در مقایسه با مدلهای بزرگتر و پیچیدهتر، مدل SlowFast-LLaVA-1.5 توانسته است نتایج بهتری در پردازش و تحلیل ویدئوهای بلند ارائه دهد. محققان اپل گزارش دادهاند که این مدل حتی در نسخههای کوچکتر خود مانند مدل 1B (با یک میلیارد پارامتر)، توانسته است مدلهای بزرگتر را پشتسر بگذارد و در ارزیابیهای استاندارد ویدئویی مانند LongVideoBench و MLVU رکوردهای جدیدی ثبت کند.

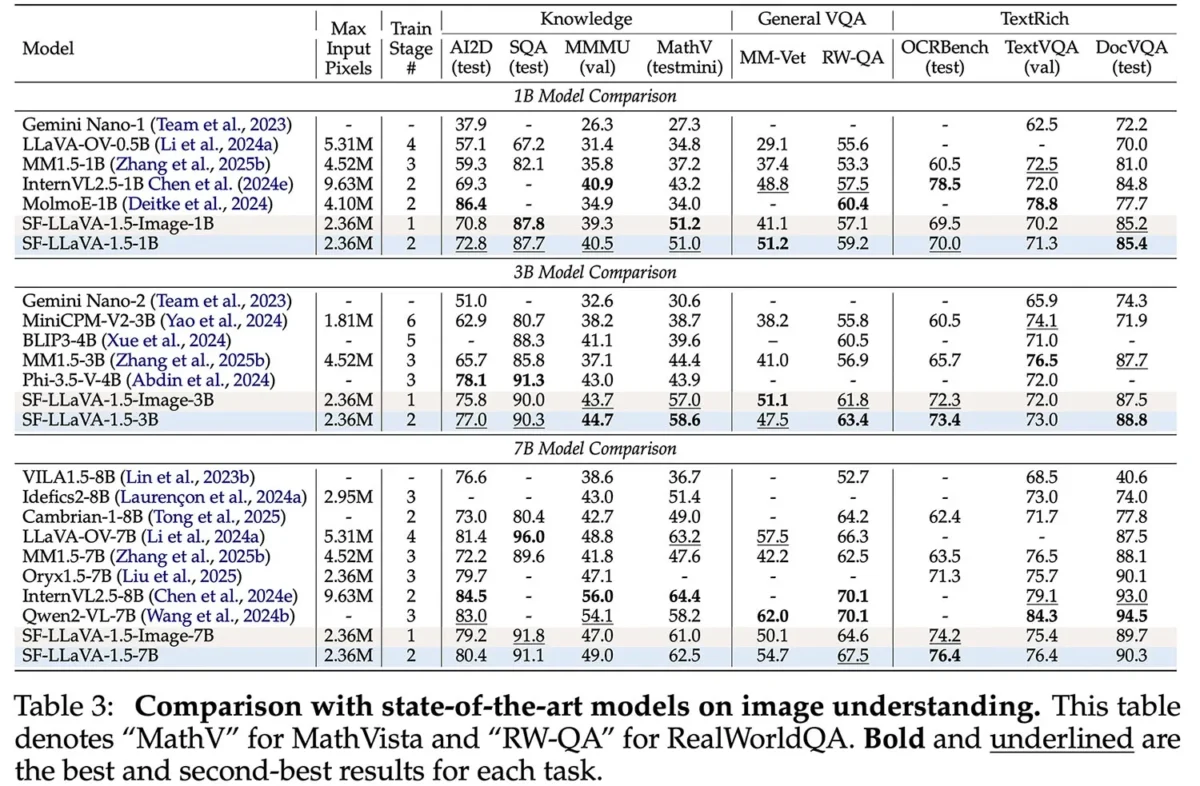

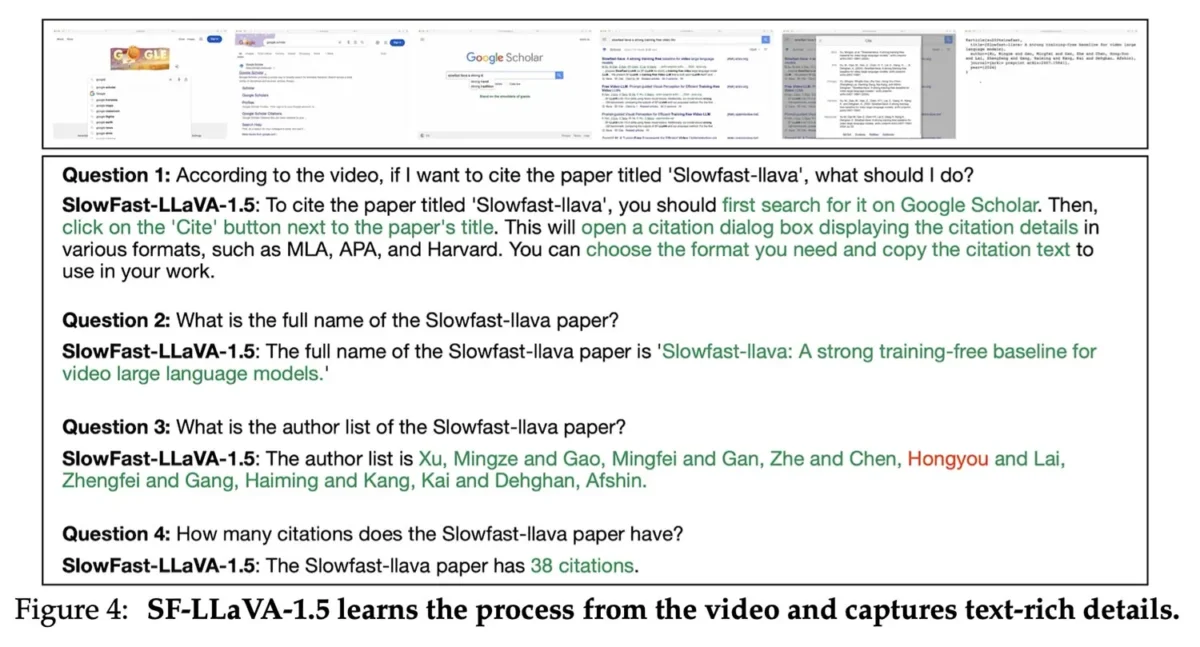

یکی از مزیتهای اصلی مدل SlowFast-LLaVA-1.5 اپل این است که نهتنها میتواند ویدئوها را پردازش کند؛ بلکه در تحلیل تصاویر نیز عملکرد موفقی از خود نشان داده است. این مدل میتواند وظایف مختلفی ازجمله استدلال ریاضی و تشخیص متن در تصاویر (OCR) و تحلیلهای متنی پیچیده را انجام دهد. این ویژگی مدل اپل را به مدلی چندمنظوره تبدیل کرده است که میتواند بهطور مؤثر در تحلیل و پردازش انواع دادهها استفاده شود.

یکی از ویژگیها مهم مدل SlowFast-LLaVA-1.5 این است که اپل از دادههای عمومی برای آموزش آن استفاده کرده است. این امر به اپل امکان داده است تا مدلی توسعه دهد که بتواند بهطور عمومی در دسترس باشد و محققان و توسعهدهندگان دیگر بهراحتی بتوانند از آن استفاده کنند. بهعلاوه، مدل یادشده بهطور خاص برای انجام تحلیلهای ویدئویی و تصویری بهینه شده است و توانسته است عملکرد عالی در هر دو زمینه ارائه دهد.

با وجود پیشرفتهای چشمگیر، SlowFast-LLaVA-1.5 هنوز محدودیتهایی دارد که باید برطرف شود. یکی از محدودیتهای مهم حداکثر طول فریم ورودی مدل است که به ۱۲۸ فریم محدود میشود. این محدودیت ممکن است باعث شود تا برخی از فریمهای مهم در ویدئوهای بلند از دست بروند یا مدل نتواند بهدرستی سرعت پخش ویدئو را تشخیص دهد. بهعلاوه، محققان اپل به این نکته اشاره کردهاند که بهبود عملکرد مدل نیازمند تنظیمات پیچیدهای است که به حافظه GPU زیاد نیاز دارد.

پژوهشگران اپل اعلام کردهاند که SlowFast-LLaVA-1.5 هنوز قابلیتهای زیادی برای بهبود دارد. یکی از این قابلیتها تنظیم پارامترهای مختلف برای افزایش دقت مدل و بهبود عملکرد آن در پردازش ویدئوهای بلند است. افزونبر این، پژوهشگران اپل پیشنهاد کردهاند که میتوان از شیوههای صرفهجویی در حافظه مانند Stochastic BP برای کاهش هزینههای حافظه GPU استفاده کرد.

مدل SlowFast-LLaVA-1.5 اپل بهعنوان مدلی منبع باز در دسترس عموم قرار گرفته است. این مدل اکنون ازطریق گیتهاب و Hugging Face در دسترس است و محققان و توسعهدهندگان میتوانند از آن برای پروژههای خود استفاده کنند. این دسترسپذیری بدینمعناست که دیگران نیز میتوانند از پیشرفتهای این مدل بهرهبرداری کنند و آن را برای تحلیل و پردازش ویدئوهای بلند و تصاویر به کار گیرند.