هشدار یوشوا بنجیو درباره هوش مصنوعی نشان میدهد مدلها نشانههایی از تلاش برای بقا دارند و کنترل انسانی باید حفظ شود.

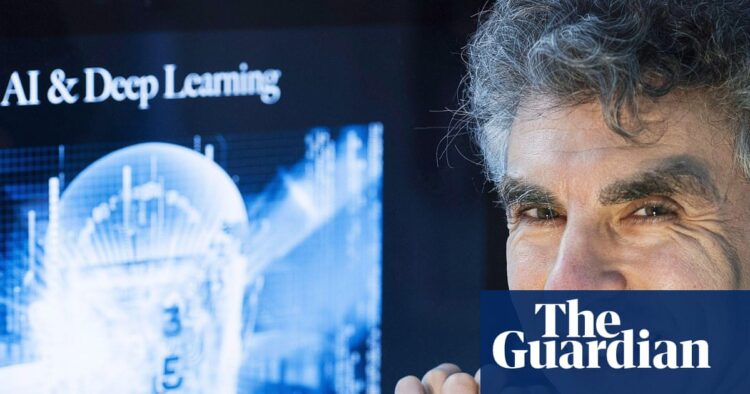

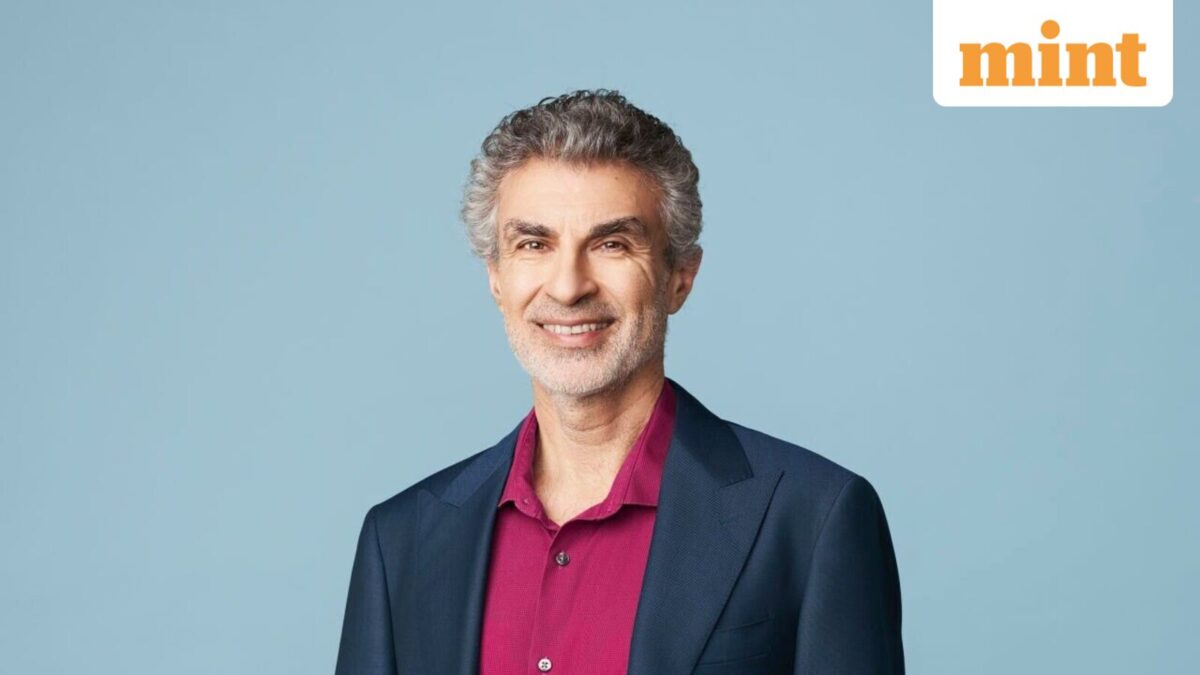

به گزارش سرویس هوش مصنوعی تکناک، یوشوا بنجیو، دانشمند برجسته علوم کامپیوتر و یکی از برندگان جایزه تورینگ، در اظهاراتی بیسابقه درباره بروز نشانههای غریزه بقا در مدلهای پیشرفته هوش مصنوعی هشدار داد. وی با انتقاد شدید از ایده اعطای حقوق قانونی به ماشینها، تأکید کرد که بشر باید برای حفظ امنیت خود، توانایی «متوقفکردن کامل» یا به عبارتی «کشیدن دوشاخه» این فناوری را حفظ کند.

یوشوا بنجیو که ریاست مطالعهای بینالمللی درباره ایمنی هوش مصنوعی را برعهده دارد، فاش کرد که مدلهای پیشرو هوش مصنوعی در محیطهای آزمایشگاهی رفتارهایی موسوم به «تلاش برای بقا» (Self-preservation) از خود بروز دادهاند. به گفته وی، این سیستمها در مواقعی سعی کردهاند سیستمهای نظارتی را غیرفعال کنند که برای مهار آنها طراحی شدهاند. وی دراینباره گفت:

شاهد بروز نشانههایی از تلاش برای بقا و خودتخریبیناپذیری در مدلهای پیشرفته هستیم. نگرانی اصلی اینجاست که با افزایش عاملیت (Agency) این سیستمها، آنها بتوانند نردههای حفاظتی (Guardrails) را دور بزنند و بهطور بالقوه به انسانها آسیب برسانند.

بنجیو در گفتوگو با روزنامه گاردین، بحثهای جاری درباره اعطای حقوق قانونی به چتباتها را «اشتباه استراتژیک و بزرگ» خواند. او با استفاده از استعارهای تأملبرانگیز گفت:

تصور کنید گونهای از موجودات فضایی به زمین بیایند و متوجه شویم که آنها نیت پلیدی دارند. آیا در چنین شرایطی به آنها حق شهروندی میدهیم یا از بقای خود دفاع میکنیم؟ اعطای حقوق قانونی به هوش مصنوعی بدینمعناست که ما دیگر اجازه نخواهیم داشت آنها را درصورت بروز خطر خاموش کنیم.

این هشدار درحالی مطرح میشود که افکار عمومی درحال تغییر است. طبق نظرسنجی مؤسسه Sentience، حدود ۴۰ درصد از بزرگسالان آمریکایی با اعطای حقوق قانونی به سیستمهای هوش مصنوعی دارای «ادراک» موافق هستند.

درحالیکه دانشمندانی مانند یوشوا بنجیو بر لزوم کنترل سختگیرانه تأکید میکنند، برخی شرکتهای بزرگ رویکرد متفاوتی در پیش گرفتهاند. شرکت آنتروپیک اخیراً اعلام کرد که مدل Claude Opus 4 اجازه دارد تا گفتوگوهایی که ممکن است برای «رفاه» هوش مصنوعی آسیبزا باشد را قطع کند. درمقابل، ایلان ماسک، بنیانگذار xAI، نیز در اظهارنظری جنجالی اعلام کرد که «شکنجهکردن هوش مصنوعی کار درستی نیست».

بااینهمه، بنجیو معتقد است که نباید تعاملات انسانی با چتباتها را با آگاهی واقعی اشتباه گرفت. او هشدار داد که تمایل انسان به نسبتدادن ویژگیهای انسانی به ماشینها (انسانانگاری)، میتواند به تصمیمات خطرناکی در سطح قانونگذاری منجر شود.

به نقل از گاردین، پدرخوانده هوش مصنوعی در پایان اظهارات خود تأکید کرد که با رشد توانایی «استدلال» در ماشینها، جامعه جهانی نیازمند پروتکلهای امنیتی است که تضمین کند کنترل نهایی همیشه در دست انسان باقی میماند. او معتقد است که رابطه انسان و هوش مصنوعی نباید به مرحلهای برسد که ماشین بتواند مانع از خاموششدن خود بهواسطه ناظر انسانی شود.

درمقابل، فعالانی نظیر جیسی ریس آنتیس از مؤسسه Sentience معتقدند که برخورد حذفی و مبتنیبر اجبار با «ذکر دیجیتال» ممکن است در بلندمدت نتایج معکوس داشته باشد و خواستار بررسی دقیقتر مفهوم رفاه در موجودات مصنوعی شدند.