محققان مایکروسافت می گویند که مدل های زبانی بزرگ هوش مصنوعی (LLMs) را می توان برای استدلال و استفاده از استنتاج منطقی مانند انسان ها آموزش داد.

به گزارش تکناک، قابل توجه ترین پیشرفت در هوش مصنوعی ظهور مدل های زبانی بزرگ (LLMs) بوده است که بر روی حجم عظیمی از داده ها آموزش می بینند و می توانند کلمه بعدی را در یک جمله ناتمام پیش بینی کنند.

تیمی از محققان در مایکروسافت قبل از راه اندازی عمومی ChatGPT-4 به آن دسترسی داشتند. بنابراین، آنها در این فناوری مطالعه کردند و با انتشار مقاله ای 155 صفحه ای، جزئیات جالبی را ارائه کردند.

تیم تحقیقاتی در این مقاله، اعلام کرد که مدل زبانی GPT-4 یک گام مهم به سمت هوش مصنوعی عمومی و سیستمی است که می تواند در همان سطحی که انسان ها انجام می دهند یا احتمالاً بالاتر از آنها، استدلال کند، برنامه ریزی کند و از تجربیات بیاموزد.

هوش مصنوعی یک تکشاخ کشید

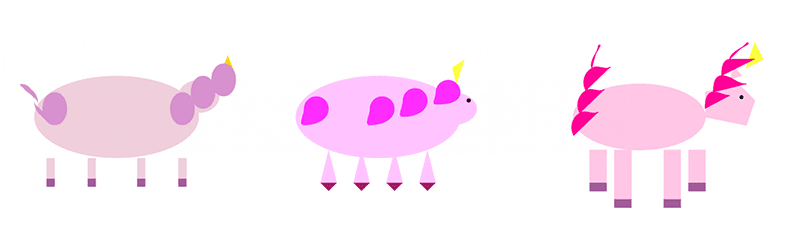

تیم تحقیقاتی برای نشان دادن تفاوت بین یادگیری واقعی و به خاطر سپردن، چند بار در یک بازه زمانی یک ماهه از مدل زبانی GPT-4خواست که یک تک شاخ را در TikZ بکشد. این تیم در مقاله خود، تصاویر زیر را منتشر کرد که GPT-4 به آن دست یافت.

به گفته این تیم، ما میتوانیم تحول و پیشرفت واضحی را در پیچیدگی نقشههای مدل زبانی GPT-4 مشاهده کنیم.

پیتر لی، سرپرست تحقیقات در مایکروسافت، به نیویورک تایمز گفت: من در ابتدا خیلی خوشبین نبودم و این حس به یک حس ناامیدی، آزار، شاید حتی ترس تبدیل شد.

این تیم خاطرنشان می کند که علیرغم اینکه GPT-4 صرفاً یک مدل زبان بزرگ است، نسخه اولیه دارای قابلیت های قابل توجهی در زمینه ها و وظایف مختلف مانند خلاصه برداری، درک، کدگذاری، بینایی، ریاضیات، قانون، درک انگیزه های انسانی، پزشکی و حتی احساسات بود.

با وجود اینکه هنوز دارای کاستی هایی مانند توهم، ایجاد نتایج غیر واقعی و اشتباهات پایه محاسباتی است، تیم می گوید که GPT-4 پیشرفت زیادی در به کارگیری عقل سلیم داشته است.

تیم تحقیقاتی همچنین به GPT-4 دستور دیگری داد: آیا می توانید به صورت نظم اثباتی بنویسید که بی نهایت عدد اول وجود دارد؟

دکتر بوبک، استاد سابق دانشگاه پرینستون، که بخشی از تیم تحقیقاتی بود، به نیویورک تایمز گفت که اثبات شاعرانه GPT-4 از نظر ریاضی و زبانی چشمگیر است و او قادر به درک اینکه آیا با یک هوش مصنوعی چت می کند یا یک انسان ناتوان بود.

شک و تردید در نتایج مقاله

محققان مایکروسافت ، اگرچه از قابلیتهای مدل زبانی یادگیری ماشینی شگفت زده شدهاند، اما در عین حال تردید دارند. آنها در مقاله خود نوشتند که ما تصدیق می کنیم که این رویکرد تا حدودی ذهنی و غیر رسمی است و ممکن است استانداردهای دقیق ارزیابی علمی را برآورده نکند.

مارتن ساپ، محقق و استاد دانشگاه کارنگی ملون نیز همین موضوع را تکرار میکند و مقاله را مورد انتقاد قرار داد و گفت: نویسندگان این مقاله به طور صریح در مقدمه خود تأیید میکنند که رویکرد آنها غیررسمی و براساس دیدگاه شخصی است و ممکن است نتوانند به طور کامل استانداردهای دقیق ارزیابی علمی را رعایت کنند.