فهرست مطالب

محققان یک مدل یادگیری ماشینی ایجاد کردند که می تواند نحوه انتشار هر صدایی در اتاق را در فضا ثبت کند و این سیستم میتواند با استفاده از صدا برای مدل سازی هر فصایی را مدل سازی کند.

به گزارش تکناک، صدایی که یک بازدیدکننده کلیسای جامع می شنود تحت تأثیر عوامل زیادی قرار می گیرد، از جمله مکان ارگ، جایی که شنونده در آن ایستاده است، ستون ها، نیمکت ها یا موانع دیگری بین آنها قرار گرفته است، دیوارها از چه چیزی ساخته شده اند، مکان ها پنجره ها یا درها و غیره. شنیدن صدا می تواند به فرد کمک کند تا محیط خود را تصور کند.

محققان MIT و آزمایشگاه هوش مصنوعی واتسون MIT-IBM در حال بررسی استفاده از اطلاعات صوتی فضایی برای کمک به ماشینها برای تجسم بهتر محیط خود هستند.

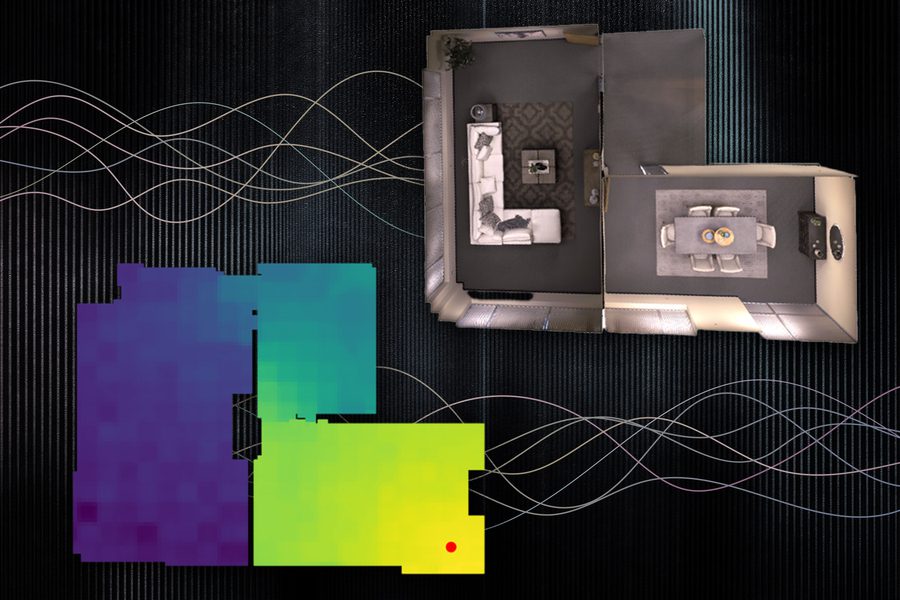

با مدلسازی دقیق آکوستیک یک صحنه، سیستم میتواند هندسه سهبعدی زیربنای یک اتاق را از ضبط صدا یاد بگیرد. محققان می توانند از اطلاعات صوتی گرفته شده توسط سیستم خود برای ساختن رندرهای بصری دقیق از یک اتاق استفاده کنند، مشابه نحوه استفاده انسان از صدا در هنگام تخمین ویژگی های محیط فیزیکی خود.

ییلون دو، دانشجوی مقطع کارشناسی ارشد در دپارتمان مهندسی برق و علوم کامپیوتر EECS و یکی از نویسندگان مقاله ای که مدل را توصیف می کند می گوید این تکنیک علاوه بر کاربردهای بالقوهاش در واقعیت مجازی و واقعیت افزوده، میتواند به عوامل هوش مصنوعی کمک کند تا درک بهتری از دنیای اطراف خود داشته باشند.

به عنوان مثال، یک ربات کاوشگر زیر آب با مدلسازی ویژگیهای آکوستیک صدا در محیط خود، میتواند چیزهایی را که دورتر از آن تنها با بینایی است، حس کند.

دو اضافه می کند: بیشتر محققان تاکنون تنها بر روی مدلسازی بینایی تمرکز کردهاند. اما ما به عنوان انسان، ادراک چندوجهی داریم. نه تنها بینایی مهم است، صدا نیز مهم است. من فکر میکنم این کار یک مسیر تحقیقاتی هیجانانگیز را در مورد استفاده بهتر از صدا برای مدلسازی جهان باز میکند.

01

از 03استفاده از صدا در واقعیت مجازی

در تحقیقات بینایی کامپیوتری، یک نوع مدل یادگیری ماشینی به نام مدل نمایش عصبی ضمنی برای ایجاد بازسازی های صاف و پیوسته صحنه های سه بعدی از تصاویر استفاده شده است. این مدلها از شبکههای عصبی استفاده میکنند که حاوی لایههایی از گرههای به هم پیوسته یا نورونها هستند که دادهها را برای تکمیل یک کار پردازش میکنند.

02

از 03چگونه مدلهای هوش مصنوعی از صدا برای درک فضا استفاده میکنند؟

محققان MIT از همین نوع مدل برای ثبت چگونگی حرکت مداوم صدا در یک صحنه استفاده کردند.داما آنها دریافتند که مدلهای بینایی از خاصیتی به نام سازگاری فتومتریک سود میبرند که برای صدا اعمال نمیشود. اگر کسی از دو مکان مختلف به یک شی نگاه کند، آن شی تقریباً یکسان به نظر می رسد. اما با صدا، مکان را تغییر دهید و صدایی که می شنود می تواند به دلیل موانع، فاصله و غیره کاملاً متفاوت باشد. این امر پیش بینی صدا را بسیار دشوار می کند.

محققان با وارد کردن دو ویژگی آکوستیک در مدل خود بر این مشکل غلبه کردند: ماهیت متقابل صدا و تأثیر ویژگیهای هندسی محلی.

صدا متقابل است، به این معنی که اگر منبع صدا و شنونده جای خود را عوض کنند، چیزی که شخص می شنود تغییری نمی کند. علاوه بر این، آنچه در یک منطقه خاص می شنود به شدت تحت تأثیر ویژگی های محلی است، مانند مانعی بین شنونده و منبع صدا.

برای گنجاندن این دو عامل در مدل خود، به نام میدان صوتی عصبی (NAF)، شبکه عصبی را با شبکهای تقویت میکنند که اشیاء و ویژگیهای معماری را در صحنه، مانند درها یا دیوارها، ثبت میکند. مدل به طور تصادفی از نقاط آن شبکه نمونه برداری می کند تا ویژگی ها را در مکان های خاص یاد بگیرد.

اگر تصور میکنید نزدیک دری ایستادهاید، آنچه که به شدت بر آنچه میشنوید تأثیر میگذارد وجود آن در است، نه لزوماً ویژگیهای هندسی دور از شما در آن سوی اتاق. ما متوجه شدیم که این اطلاعات تعمیم بهتری را نسبت به یک شبکه کاملاً متصل ساده امکان پذیر می کند.

03

از 03چرا ترکیب صدا و تصویر دقت درک ماشین را افزایش میدهد؟

محققان میتوانند اطلاعات بصری NAF را در مورد یک صحنه و چند طیفنگار که نشان میدهند وقتی فرستنده و شنونده در مکانهای مورد نظر در اطراف اتاق قرار دارند، صدای یک قطعه صدا را به NAF ارائه دهند. سپس مدل پیشبینی میکند که اگر شنونده به هر نقطهای از صحنه حرکت کند، صدا چگونه خواهد بود.

NAF یک پاسخ ضربتی تولید می کند که نحوه تغییر صدا را در حین انتشار در صحنه نشان می دهد. سپس محققان این پاسخ ضربتی را به صداهای مختلف اعمال می کنند تا بشنوند که چگونه این صداها وقتی یک فرد در اتاقی قدم می زند تغییر کنند.

به عنوان مثال، اگر آهنگی از یک بلندگو در مرکز اتاق پخش میشود، مدل آنها نشان میدهد که چگونه وقتی فردی به بلندگو نزدیک میشود، این صدا بلندتر میشود و سپس هنگام خروج به راهروی مجاور خاموش میشود.

وقتی محققان تکنیک خود را با روشهای دیگری که اطلاعات صوتی را مدلسازی میکنند مقایسه کردند، تکنیک آنها در همه حالت ها مدل صوتی دقیقتری تولید کرد و چون اطلاعات هندسی محلی را یاد گرفت، مدل آنها توانست خیلی بهتر از روش های دیگر در مکان های جدید مورد استفاده قرار گیرد.

علاوه بر این، آنها دریافتند که استفاده از اطلاعات آکوستیکی آنها در یک مدل کامپیوتری تصویری می تواند منجر به بازسازی بصری بهتر صحنه شود.

برای مثال، وقتی شما فقط مجموعهای از تصاویر کمی دارید، استفاده از صدا برای مدل سازی به شما امکان میدهد تا مرزها را با وضوح بیشتری ثبت کنید. و شاید به این دلیل باشد که برای ارائه دقیق آکوستیک یک صحنه، باید هندسه سه بعدی زیربنایی آن صحنه را ثبت کنید.

محققان قصد دارند به بهبود این مدل ادامه دهند تا بتواند به صحنه های کاملاً جدید تعمیم یابد. آنها همچنین میخواهند این تکنیک را برای پاسخهای ضربتی پیچیدهتر و صحنههای بزرگتر، مانند کل ساختمانها یا حتی یک شهر یا شهر، به کار ببرند.

این تکنیک جدید ممکن است فرصت های جدیدی را برای ایجاد یک تجربه همهجانبه چندوجهی در برنامه متاورس ایجاد کند.

دینش منوچا، پروفسوراستاد علوم کامپیوتر و مهندسی برق و کامپیوتر در دانشگاه مریلند، که در این زمینه دخالتی نداشت، میگوید: این گروه کارهای زیادی روی استفاده از روشهای یادگیری ماشینی برای تسریع شبیهسازی آکوستیک یا مدلسازی آکوستیک صحنههای دنیای واقعی انجام داده و نویسندگان این مقاله شامل چوانگ گان و همکارانش به وضوح یک گام به جلو در این مسیر برداشته اند.

این مقاله یک نمایش ضمنی خوب با استفاده از صدا برای مدل سازی را معرفی میکند که میتواند نحوه انتشار صدا در صحنههای دنیای واقعی را با مدلسازی آن با استفاده از یک سیستم خطی زمان ناپذیر، به تصویر بکشد. این اثر می تواند کاربردهای زیادی در AR/VR و همچنین درک صحنه های دنیای واقعی داشته باشد.

بخشی از این تحقیق توسط آزمایشگاه هوش مصنوعی MIT-IBM Watson و موسسه Tianqiao و Chrissy Chen پشتیبانی میشود.