مایکروسافت پتنت ابزاری جدید را ثبت کرده است که با هدف بهبود مفهوم مدلهای یادگیری عمیق استفادهشده در شناسایی تصویر و هوش مصنوعی بصری طراحی شده است.

بهگزارش تکناک، مایکروسافت بهمنظور فهم بهتر فرایندهای درونی مدلهای هوش مصنوعی، بهدنبال ساختن مدلهایی است که روشهای خود را برای رسیدن به نتایج میتوانند توضیح دهند. این رویکرد به مقابله با سوءتفاهمها کمک میکند و درنتیجه، اعتماد کاربران به فناوری را افزایش میدهد.

برای رسیدن به این هدف، ردموندیها بهدنبال ثبت پتنت ابزار تشخیصی برای تشخیص شباهت مدلهای یادگیری عمیق هستند. فناوری مایکروسافت با هدف ارائه بینشی درباره نحوه تصمیمگیری شبکههای عصبی، بهویژه خاص مدلهای تشخیص تصویر و هوش مصنوعی بصری، فعالیت میکند.

مایکروسافت در پرونده ثبت پتنت خود آورده است:

ازآنجاکه این مدلها اغلب مدلهای یادگیری عمیق (مثلاً 50 لایه) هستند که با استفاده از مجموعهای از تصاویر برچسبخورده (تگگذاریشده) آموزش دیدهاند، تصمیمات مبتنیبر یادگیری ماشینی تا حد زیادی بهعنوان فرایندهای جعبه سیاه تلقی می شوند. درنتیجه، تصمیمات مدلهای یادگیری ماشینی ممکن است بدون توضیح رها شوند.

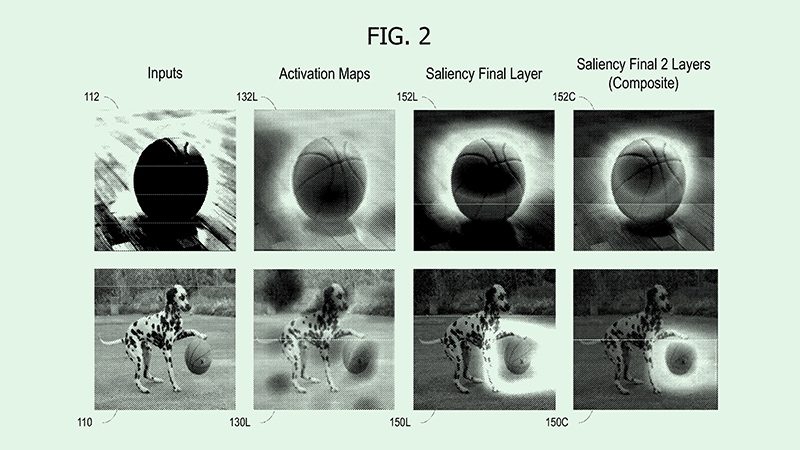

بهنقل از وبسایت The Daily Upside، سیستم مایکروسافت این بینش را با ایجاد نقشه برجستگی یا نمایش بصری ارائه میدهد که نشان میدهد چگونه مدل هوش مصنوعی بصری تحتتأثیر دادههای ورودی خود قرار میگیرد.

ابتدا شبکه عصبی طبقهبندی تصویر وظیفه خود را برای شناسایی و دستهبندی عناصر درون عکس انجام میدهد. پس از اتمام این کار، ابزار مایکروسافت وارد عمل میشود و نقشه فعالسازی برای لایهای از شبکه عصبی تعیین میکند. این نقشه فعالسازی مشخص میکند که کدام مناطق خاص از تصویر، نورونهای خاصی را در لایه شبکه عصبی فعال کردهاند.

سپس ابزار نقشه شیبی برای آن لایه ایجاد میکند که از شیبها برای نشاندادن حساسیت مدل به قسمتهای مختلف تصویر استفاده میکند. با ترکیب این دو نقشه، سیستم نقشه برجستگی بهوجود میآورد که تجزیهوتحلیل میکند کدام قسمتهای تصویر بر نحوه تصمیمگیری مدل برای طبقهبندی یا شناسایی آن تأثیر میگذارد.

بهعنوان مثال، اگر تصویر ورودی عکسی از اردک در برکهای باشد که بهواسطه مدل بهعنوان تصویری از پرنده طبقهبندی شده باشد، ممکن است نقشه برجستگی بهشکل دایرهای شیبدار بهطور خاص اطراف اردک بهنظر برسد و هر چیز دیگری را در تصویر محو کند.

یافتن راههایی برای توضیح عملکرد مدلهای هوش مصنوعی میتواند برای کشف اینکه زمانیکه مدلها پاسخهای اشتباه میدهند یا سوگیریها را بازتولید میکنند، بسیار مهم باشد. با پیادهسازی مکانیزمهایی که به هوش مصنوعی اجازه میدهند کار خود را نشان دهند، فناوریهای اینچنینی میتوانند به توسعهدهندگان کمک کنند تا بهسرعت مشکلات را تشخیص و مدلها را برای رفع آنها مجدداً آموزش دهند. ازآنجاکه حق پتنت جدید مایکروسافت بهطور خاص روی مدلهای بصری تمرکز دارد، به توسعهدهندگان کمک میکند تا تشخیص چهره و بینایی رایانهای را دقیقتر کنند.

پتنت مایکروسافت، تنها یکی از چندین پتنت ماههای اخیر است که هدفش رمزگشایی از اتفاقات درون مدل هوش مصنوعی است. اوراکل بهدنبال پتنت بینشهای درکپذیر نزد انسان برای شبکههای عصبی است و اینتل بهدنبال ثبت پتنتی برای ردیابی و توضیح سوءاستفاده از هوش مصنوعی است. دراینمیان، حتی بوئینگ نیز برای هوش مصنوعی توضیحدادنی در ساختوساز درخواست ثبت پتنت کرده است. همه این پروندهها موضوع اصلی مشابهی را در سراسر بخشها منتقل میکنند: مردم بهطورکلی به هوش مصنوعی اعتماد ندارند.

طبق نظرسنجی جهانی از 17 هزار نفر درباره اعتماد به هوش مصنوعی از KPMG، بیش از 60 درصد شرکتکنندگان درباره اعتماد به مدلهای هوش مصنوعی محتاط بودند و حدود 75 درصد گفتند که اگر اقدامات حفاظتی و نظارت مناسب وجود داشته باشد، به سیستمهای هوش مصنوعی بیشتر اعتماد خواهند کرد. ایجاد و اجرای ابزارهای تشخیصی بیشتر برای مدلهای هوش مصنوعی میتواند به ایجاد این اعتماد کمک کند.

علاوهبراین، درحالیکه این پتنت روی هوش مصنوعی بصری متمرکز است، امکان توضیحدادن میتواند به مایکروسافت مرتبط باشد؛ زیرا این شرکت و OpenAI بهدلیل نقض حق چاپ با نیویورکتایمز درگیر نبرد حقوقی هستند و ادعا میکنند که این شرکتها از مقالههای این نشریه برای آموزش مدلهای زبان بزرگ پشت ChatGPT و Copilot استفاده کردهاند.