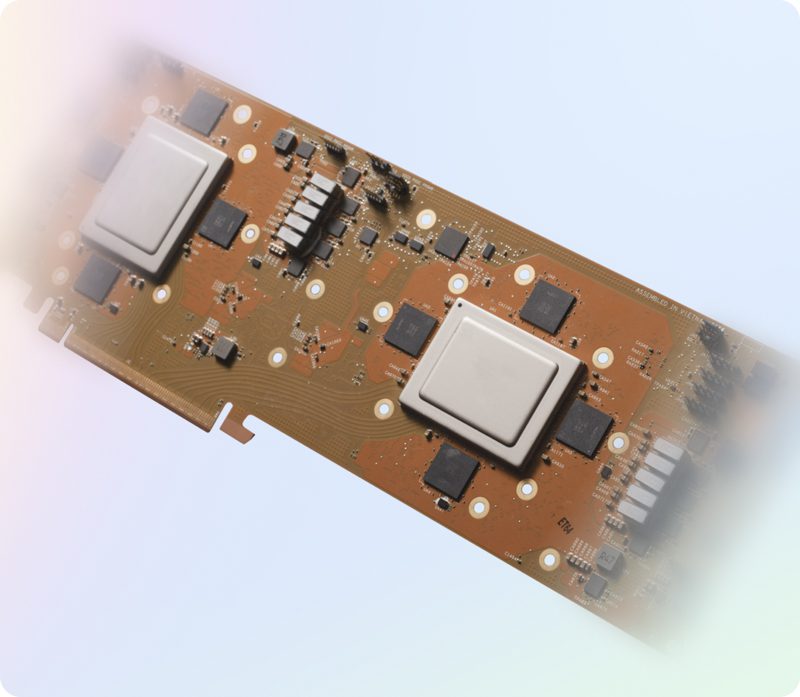

متا از تراشه جدید سفارشی هوش مصنوعی موسوم به “MTIA نسل بعدی ” رونمایی کرد که MTIA v1 نام دارد و برای اجرا و آموزش مدلهای هوش مصنوعی طراحی شده است.

به گزارش تکناک، متا، که مصمم به رقابت با رقبای خود در فضای هوش مصنوعی مولد است، میلیاردها دلار برای تلاشهای هوش مصنوعی خود هزینه میکند. بخشی از این میلیاردها صرف جذب پژوهشگران هوش مصنوعی میشود. اما بخش حتی بزرگتری صرف توسعه سختافزار، بهویژه تراشههایی برای اجرای و آموزش مدلهای هوش مصنوعی متا میشود.

این رونمایی یک روز پس از رونمایی آخرین سختافزار شتابدهنده هوش مصنوعی توسط اینتل انجام شد. این تراشه که «نسل بعدی» شتابدهنده آموزش و استنتاج متا (MTIA) نامیده میشود، جانشین MTIA v1 سال گذشته است و مدلهایی را برای رتبهبندی و توصیه تبلیغات نمایشی در سرویسهای متا (بهعنوان مثال فیسبوک) اجرا میکند.

در مقایسه با MTIA v1 که با فرآیند ۷ نانومتری ساخته شده بود، MTIA نسل بعدی ۵ نانومتری است. (در ساخت تراشه، «فرآیند» به اندازهی کوچکترین مؤلفهای که میتوان روی تراشه ساخت اشاره دارد.) MTIA نسل بعدی از نظر فیزیکی بزرگتر است و هستههای پردازشی بیشتری نسبت به نسل قبلی خود دارد.

در حالی که این تراشه مصرف برق بیشتری دارد (۹۰ وات در مقابل ۲۵ وات) اما همچنین حافظه داخلی بیشتری (۱۲۸ مگابایت در مقابل ۶۴ مگابایت) دارد و با سرعت کلاک متوسط بالاتری (۱.۳۵ گیگاهرتز در مقابل ۸۰۰ مگاهرتز) کار میکند.

متا میگوید MTIA نسل بعدی در حال حاضر در ۱۶ منطقه از مراکز دادهی آنها فعال است و عملکردی تا ۳ برابر بهتر از MTIA v1 ارائه میدهد. اگر ادعای «۳ برابر» کمی مبهم به نظر میرسد، در اشتباه نیستید – ما هم همین فکر را میکردیم. اما متا تنها فاش کرد که این رقم از تست عملکرد «چهار مدل کلیدی» در هر دو تراشه به دست آمده است.

متا در پست وبلاگی مینویسد: «از آنجایی که ما کل مجموعه را کنترل میکنیم، میتوانیم به کارایی بیشتری نسبت به پردازندههای گرافیکی در دسترس تجاری دست یابیم.»

رونمایی سختافزار متا که تنها ۲۴ ساعت پس از یک نشست خبری مطبوعاتی در مورد ابتکارات هوش مصنوعی مولد ی در حال اجرای شرکت انجام شد – به دلایل متعددی غیرعادی است.

متا همچنین در پست وبلاگی خود فاش کرد که در حال حاضر از MTIA نسل بعدی برای کارهای آموزشی هوش مصنوعی مولد استفاده نمیکند، اگرچه این شرکت ادعا میکند که «چندین برنامه در حال اجرا» برای بررسی این موضوع دارد.

متا اعتراف اذعان کرد که MTIA نسل بعدی جایگزین پردازندههای گرافیکی برای اجرای یا آموزش مدلها نخواهد شد، بلکه آنها را تکمیل میکند.

تیمهای هوش مصنوعی متا تقریبا به طور قطع تحت فشار برای کاهش هزینهها هستند. این شرکت قرار است تا پایان سال ۲۰۲۴ حدود ۱۸ میلیارد دلار برای پردازندههای گرافیکی (GPU) جهت آموزش و اجرای مدلهای هوش مصنوعی مولد هزینه کند. از آنجایی که هزینههای آموزش برای مدلهای تولیدکننده پیشرفته در حدود دهها میلیون دلار است، سختافزار داخلی، جایگزین جذابی به نظر میرسد.

در حالی که سختافزار متا عقب است، رقبایشان با سرعت جلو میروند که به احتمال زیاد باعث ناراحتی رهبری متا شده است. گوگل این هفته پنجمین نسل تراشه سفارشی خود را برای آموزش مدلهای هوش مصنوعی، TPU v5p، در اختیار مشتریان Google Cloud قرار داد و اولین تراشه اختصاصی خود را برای اجرای مدلها، Axion، معرفی کرد.

آمازون چندین خانواده تراشه هوش مصنوعی سفارشی در اختیار دارد. مایکروسافت نیز سال گذشته با شتابدهنده هوش مصنوعی Azure Maia و پردازنده مرکزی Azure Cobalt 100 وارد این رقابت شد.

متا در وبلاگ خود میگوید که کمتر از ۹ ماه طول کشیده است تا «از اولین سیلیکون به مدلهای تولیدی» نسل بعدی MTIA برسد که برای منصفانه بودن، کوتاهتر از فاصله زمانی معمول بین TPU های گوگل است. اما اگر متا امیدوار است به اندازهای از وابستگی به پردازندههای گرافیکی شخص ثالث دست یابد و با رقابت سرسخت خود برابری کند، کار زیادی برای جبران عقبماندگی دارد.